毕业设计:基于机器学习的车道线检测偏离预警系统 人工智能 python 目标检测

毕业设计:基于机器学习的车道线检测偏离预警系统利用计算机视觉和深度学习算法,实现对车辆行驶过程中车道线的实时检测和偏离预警。我们采用了先进的图像处理和机器学习技术,并通过大量的道路图像进行训练和优化,提高了系统的检测准确率和实时性。对于计算机专业、软件工程专业、人工智能专业、大数据专业的毕业生而言,提供了一个具有挑战性和创新性的研究课题。无论您对深度学习技术保持浓厚兴趣,还是希望探索机器学习、算法

目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

大家好,这里是海浪学长计算机毕设专题,本次分享的课题是

🎯基于机器学习的车道线检测偏离预警系统

项目背景

随着交通流量的增加和道路安全的关注,车道线检测偏离预警系统在现代驾驶辅助系统中扮演着重要角色。该系统利用计算机视觉和机器学习技术,通过识别和分析车辆行驶过程中的车道线信息,实时监测车辆是否偏离车道,及时发出预警,提醒驾驶员采取措施。这种基于机器学习的车道线检测偏离预警系统具有重要意义,能够提高驾驶安全性,减少交通事故发生率。通过该课题的研究,可以推动自动驾驶技术的发展,为智能交通系统的建设和道路安全提供有效支持。

数据集

由于网络上缺乏现有适用于基于机器学习的车道线检测偏离预警系统的数据集,我决定使用网络爬虫技术进行数据采集,并制作了一个全新的数据集。该数据集通过爬取各种道路场景的图像,包括城市道路、高速公路等,其中涵盖了不同天气、道路标志和车道线类型的情况。通过网络爬取和筛选,我获取了大量真实且多样化的图像数据,这将为我的研究提供更准确、可靠的数据基础。我相信这个自制的数据集将为基于机器学习的车道线检测偏离预警系统的研究提供有力的支持,并为该领域的发展做出积极贡献。

为了提高基于机器学习的车道线检测偏离预警系统的性能和鲁棒性,我对自制数据集进行了扩充。除了网络爬取的图像数据外,我还利用图像处理技术对原始图像进行了增强和变换,包括亮度调整、模糊处理、旋转和缩放等操作。通过数据扩充,我增加了数据集的多样性和数量,使系统能够更好地适应各种复杂的道路场景和光照条件。这样的数据扩充方法提高了系统的鲁棒性,并使其更适用于不同的实际驾驶情况。

设计思路

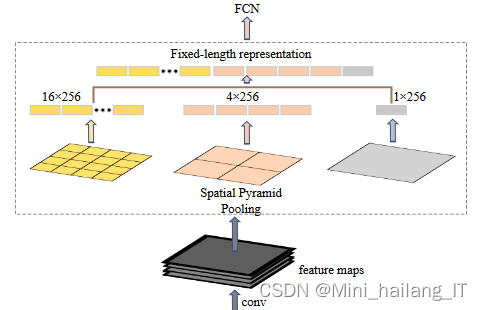

空间金字塔池化(SPP)模块通过设置不同大小的刻度,可以对输入图片进行多尺度特征提取,从而输出固定大小的特征向量,保证了图像的有效空间区域。相比于传统的裁剪或缩放方法,SPP模块可以在不丢失原始信息的情况下,获取更全局的感受野,提高了网络对于不同大小图片输入的适应能力。SPP模块的主要思想是将输入图片划分为多个不同大小的网格,并在每个网格内进行池化操作,最后将各个网格的池化结果拼接在一起形成固定长度的特征向量。这样可以保留不同尺度的空间信息,并且不受输入图片大小的限制。通过使用SPP模块,网络可以在提取特征时考虑到不同尺度的物体或特征,从而增强了模型的感知能力和表达能力。SPP模块的输出特征向量可以作为后续任务的输入,例如目标检测、图像分类等,能够有效地提高模型的性能和鲁棒性。

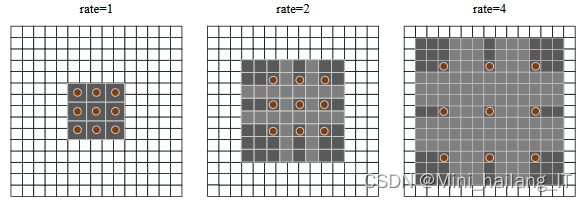

空洞卷积(或称为膨胀卷积)是在标准卷积的基础上改进而来的技术,通过在卷积核元素之间填充零的方式来膨胀自身卷积核。在卷积神经网络中使用空洞卷积技术有以下三个好处:

- 扩大感受野:空洞卷积可以在不丢失特征图分辨率且保持像素相对空间位置不变的条件下,扩大图像的感受野。传统的卷积操作只能感知局部信息,而通过调整空洞卷积的膨胀率,可以增加卷积核感受野的大小,从而获取更广阔的上下文信息,解决特征图细节信息丢失的问题。

- 多尺度上下文信息提取:使用不同空洞卷积系数的卷积核叠加时,网络模型可以获得包含更多语义信息的特征图。通过使用不同膨胀率的空洞卷积核,可以提取多尺度的上下文信息,有利于模型对不同尺度物体或特征的建模与识别。

- 计算效率高:空洞卷积技术不需要引入额外的参数,因此可以减少网络的计算量。相比于传统的卷积操作,在保持感受野扩大和特征图分辨率的同时,空洞卷积具有更高的计算效率,能够满足车道线检测等实时性要求,提高检测效率。

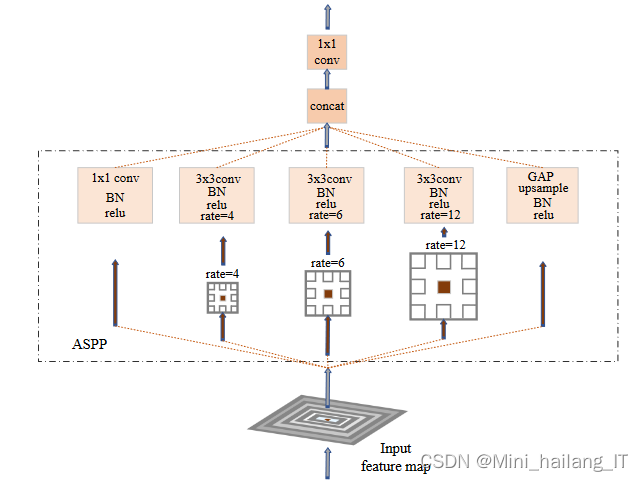

在车道线特征提取任务中,由于车道线外表特征不明显且易受周围环境干扰,导致传统卷积神经网络得到的车道线特征图尺寸较小。这是因为在卷积神经网络中,神经元感受野内的像素对输出向量的影响呈高斯分布,并且随着距离中心的增加而快速衰减。为了解决这个问题,扩大车道线特征图的感受野,增强网络对车道线上下文信息的利用,本文引入了空洞空间金字塔池化模块(ASPP)并结合空洞卷积和空间金字塔池化技术进行设计。

ASPP模块在不改变输入特征图尺寸的情况下,通过引入多个不同膨胀率的空洞卷积核,扩大了输入图像的感受野。通过空洞卷积的特性,ASPP模块可以获取不同尺度的上下文信息,并且在空间金字塔池化层中进行池化操作,进一步提取多尺度的特征。这种设计有效地增强了网络模型对车道线位置信息的重要性,提高了特征提取网络对车道线上下文信息的利用率。

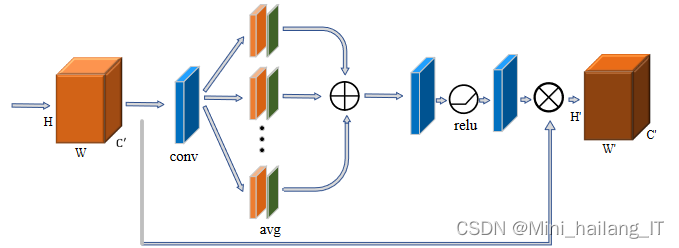

为了获取更高层的车道线全局语义信息,研究中引入了改进的空间注意力模块,结合了通道注意力模块和空间注意力机制。该模块的目标是通过过滤图像背景干扰噪声,突出目标特征,并使不同通道上的每个像素点都能关注到图像的全局信息,从而增强网络对特征的提取能力。

空间注意力模块首先接收通道注意力模块生成的加权特征图作为输入,然后利用卷积运算得到每个通道所对应的语义信息。随后,对各通道的语义特征进行平均池化操作,并将池化层输出的特征图与原始输入特征图进行进一步融合。接下来,通过两层卷积操作调整通道数,既匹配原始输入特征图的大小,也加深网络层次,有利于获取高层复杂抽象的语义信息。最后,利用sigmoid函数获得空间注意力的权重值,并将其与输入特征图相乘,从而生成具有车道线全局语义信息的特征图。

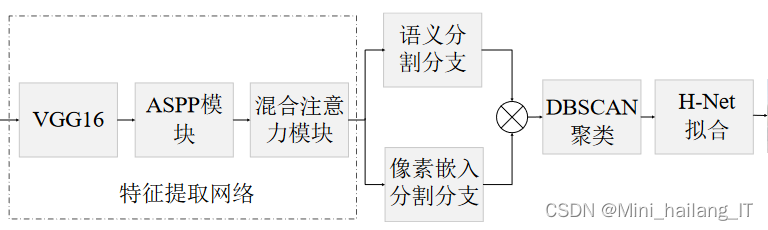

在特征提取部分,引入了空洞空间金字塔池化模块(ASPP)和混合注意力模块。ASPP模块通过并行采样再融合的方式,扩大特征图感受野,提升网络获取多尺度上下文信息的能力。混合注意力模块在通道和空间两个主要维度上提取特征,通过捕获不同通道之间的相关信息和突出空间权重信息,增强网络对特征的提取能力,并细化车道线位置信息。特征提取网络获取的全局特征图被送入解码部分,解码部分包括语义分割分支和像素嵌入分割分支。语义分割分支用于将车道线像素与背景区分开,而像素嵌入分割分支用于输出车道线像素嵌入图,通过比较嵌入空间中车道线像素距离的远近,实现对像素点所属车道线的区分。在双分支车道线信息得到后,通过DBSCAN聚类算法进行后处理操作,以加快网络聚类速度,节省计算时间。使用H-Net网络对车道线进行拟合,从而得到最终的车道线检测结果。

车道线检测算法在Ubuntu 18.04操作系统下进行开发,采用TensorFlow深度学习框架(版本1.15.5)进行模型训练和推理。算法使用NVIDIA TESLA P100显卡进行GPU加速,并且显存大小为16G。为了实现GPU加速,所使用的CUDA驱动版本为10.0。使用Python 3.7作为主要开发语言,借助Python的强大生态系统和深度学习库来实现算法的各个模块。同时,算法使用OpenCV库作为图像处理的基本框架,提供了丰富的图像处理和计算机视觉功能,方便对输入图像进行预处理和后处理操作。

准确率(Accuracy)、误检率(FP)、漏检率(FN)、帧率(FPS)和平均聚类时间作为实验评价指标通过对这五个实验评价指标的分析,可以全面评估两种车道线检测模型的性能表现。准确率、误检率和漏检率反映了模型的检测准确性和鲁棒性,而帧率和平均聚类时间则关注算法的实时性能和效率。通过综合考虑这些指标,可以评估模型在不同方面的表现,并选择最适合实际应用场景的车道线检测算法。

相关代码示例:

def lane_departure_warning(image):

processed_image = preprocess_image(image)

predicted_mask = model.predict(np.expand_dims(processed_image, axis=0))[0]

binary_mask = (predicted_mask > 0.5).astype(np.uint8)

lane_pixels = extract_lane_pixels(binary_mask)

lane_center = calculate_lane_center(lane_pixels)

deviation = calculate_deviation(lane_center, image.shape[1])

if deviation < -0.1:

print("车辆偏离左侧车道!")

elif deviation > 0.1:

print("车辆偏离右侧车道!")

else:

print("车辆行驶正常。")

def preprocess_image(image):

processed_image = image

return processed_image

def extract_lane_pixels(binary_mask):

lane_pixels = binary_mask

return lane_pixels

def calculate_lane_center(lane_pixels):

lane_center = lane_pixels

return lane_center

def calculate_deviation(lane_center, image_width):

deviation = lane_center - image_width / 2

return deviation海浪学长项目示例:

更多帮助

更多推荐

已为社区贡献71条内容

已为社区贡献71条内容

所有评论(0)