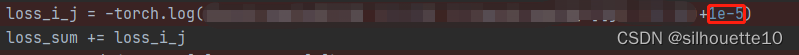

pytorch模型训练时出现loss=inf现象

参看了一些博主写的文章,开始以为是学习率的问题,将学习率改为0,还是INF,由此可知不是学习率问题。之后注意到在自己构造的loss中用到了log,所以在log(*)括号中添加了一个bias,取值为1e-5,就解决了。参考:https://blog.csdn.net/wilbur520/article/details/115335402https://wenku.baidu.com/view/323

·

参看了一些博主写的文章,开始以为是学习率的问题,将学习率改为0,还是INF,由此可知不是学习率问题。

之后注意到在自己构造的loss中用到了log,所以在log(*)括号中添加了一个bias,取值为1e-5,就解决了。

参考:

https://blog.csdn.net/wilbur520/article/details/115335402

https://wenku.baidu.com/view/323cede25bf5f61fb7360b4c2e3f5727a5e924aa.html

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)