提示工程架构师进阶之路:AI提示系统设计与高级实践指南

当你能写出"让AI生成一篇符合SEO的博客"这样的Prompt时,你是Prompt工匠;当你能设计"支撑10万用户同时咨询的企业客服AI系统"时,你才是提示工程架构师。用"餐厅点餐流程"类比提示系统的核心组件,让你秒懂上下文管理、工具调用的底层逻辑;用Python实现一个可扩展的多轮对话框架,掌握"系统Prompt+上下文窗口+工具调用"的三位一体设计;结合企业客服、AI编程助手等真实案例,解决"

提示工程架构师进阶之路:从 Prompt 工匠到 AI 对话系统设计师的高级实践指南

关键词

提示工程架构、上下文管理、多轮对话设计、工具调用系统、动态Prompt优化、评估体系、企业级AI应用

摘要

当你能写出"让AI生成一篇符合SEO的博客"这样的Prompt时,你是Prompt工匠;当你能设计"支撑10万用户同时咨询的企业客服AI系统"时,你才是提示工程架构师。

本文将带你完成从"写好单个Prompt"到"设计复杂AI对话系统"的进阶:

- 用"餐厅点餐流程"类比提示系统的核心组件,让你秒懂上下文管理、工具调用的底层逻辑;

- 用Python实现一个可扩展的多轮对话框架,掌握"系统Prompt+上下文窗口+工具调用"的三位一体设计;

- 结合企业客服、AI编程助手等真实案例,解决"上下文溢出"“意图漂移”"工具调用安全性"等进阶问题;

- 展望"动态Prompt生成""多模态提示系统"等未来趋势,让你提前布局下一个技术风口。

无论你是想晋升架构师的资深Prompt工程师,还是想搭建企业级AI应用的技术管理者,本文都能给你一套可落地的系统设计方法论。

一、背景介绍:为什么需要提示工程架构师?

1.1 从"单轮Prompt"到"复杂系统"的行业变迁

2023年之前,提示工程的核心是"如何写一个好的单轮Prompt"——比如"写一首关于春天的诗"。但随着ChatGPT插件、Claude 3 Function Call、阿里云通义千问企业版等工具的普及,AI应用的复杂度呈指数级增长:

- 企业客服AI需要记住用户30分钟前的订单信息(上下文管理);

- AI编程助手需要调用GitHub API查询代码库(工具调用);

- 多模态生成系统需要结合文字描述和图片特征生成视频(跨模态提示)。

此时,“单个Prompt"已经无法支撑复杂场景,需要一套"提示系统"来协调用户输入、上下文、工具、输出之间的关系。而设计这套系统的人,就是"提示工程架构师”。

1.2 目标读者:谁需要读这篇文章?

- 资深Prompt工程师:能写出高质量单轮Prompt,但想提升到"设计系统"的层次;

- AI应用开发者:需要搭建企业级对话系统(如客服、销售、办公助手);

- 技术管理者:想理解AI系统的底层逻辑,评估团队的Prompt设计能力。

1.3 核心挑战:从"工匠"到"架构师"的3个跨越

- 跨越1:从"解决具体问题"到"解决通用问题":比如从"写一个生成博客的Prompt"到"设计一个能生成任意行业博客的Prompt系统";

- 跨越2:从"关注Prompt本身"到"关注系统协同":比如考虑上下文如何存储、工具如何调用、输出如何格式化;

- 跨越3:从"经验驱动"到"数据驱动":比如用评估指标(如准确率、召回率)优化Prompt,而不是靠感觉。

二、核心概念解析:用"餐厅点餐"类比提示系统

为了让复杂的系统设计变得易懂,我们用"餐厅点餐流程"来类比提示系统的核心组件。想象你是一家餐厅的经理,需要设计一套"让顾客满意的点餐流程",这套流程对应的就是"AI提示系统"。

2.1 提示系统的"四大组件":像餐厅一样运转

| 餐厅组件 | 提示系统组件 | 作用说明 |

|---|---|---|

| 顾客(User) | 用户输入(User Input) | 提出需求(如"我要一份番茄鸡蛋面,不要辣") |

| 服务员(Waiter) | 上下文管理器(Context Manager) | 记住顾客的历史需求(如"上次他不要辣"),协调后续流程 |

| 菜单(Menu) | 系统Prompt(System Prompt) | 定义服务规则(如"所有菜品需确认辣度"),指导服务员如何处理需求 |

| 厨房(Kitchen) | 工具调用系统(Tool Caller) | 执行具体任务(如"做番茄鸡蛋面"),返回结果(如"菜品已做好") |

2.2 关键概念1:系统Prompt——餐厅的"服务准则"

系统Prompt是提示系统的"总规则",就像餐厅的"服务准则"。它定义了AI的角色、目标、约束条件,比如:

“你是一家高端西餐厅的服务员,负责解答顾客的点餐问题。要求:1. 用礼貌的语气;2. 确认顾客的 dietary restrictions(饮食限制);3. 推荐当日特色菜。”

为什么系统Prompt如此重要?

- 它让AI"知道自己是谁":避免AI像"万能助手"一样回答所有问题(比如顾客问"如何修电脑",AI应回复"抱歉,我是餐厅服务员,无法解答电脑问题");

- 它让AI"知道该怎么做":比如要求"确认饮食限制",避免给素食顾客推荐牛排;

- 它让系统"可扩展":通过修改系统Prompt,可以快速将"餐厅服务员"变成"企业客服"或"AI编程助手"。

2.3 关键概念2:上下文管理——服务员的"记忆能力"

上下文管理是提示系统的"记忆中枢",就像服务员记住顾客的"历史点餐偏好"。比如:

- 顾客第一次说"我要番茄鸡蛋面,不要辣";

- 顾客第二次说"再加点饮料";

- 服务员需要记住"不要辣"的偏好,避免给顾客上辣的饮料。

上下文管理的核心问题:

- 存储什么?:需要保留对当前对话有价值的信息(如用户的偏好、之前的提问),过滤无关信息(如用户的口头禅);

- 如何存储?:常用的策略有"滑动窗口"(保留最近N轮对话)、“摘要”(将长对话压缩成关键信息)、“关键词提取”(提取用户的核心需求);

- 如何使用?:将上下文嵌入到Prompt中,让AI"回忆"之前的对话(如"根据之前的对话,您不要辣,对吗?")。

2.4 关键概念3:工具调用——厨房的"执行能力"

工具调用是提示系统的"执行引擎",就像厨房根据订单做餐。比如:

- 顾客说"我想查一下我的订单状态";

- 服务员(上下文管理器)确认顾客的订单号;

- 调用"订单查询API"(工具)获取状态;

- 将结果返回给顾客。

工具调用的核心流程(用Mermaid流程图表示):

graph TD

A[用户输入:"查订单状态"] --> B[上下文管理器:提取订单号]

B --> C[系统Prompt:判断是否需要调用工具]

C -->|需要| D[工具调用系统:调用订单API]

D --> E[获取API结果]

E --> F[生成回答:"您的订单已发货"]

C -->|不需要| F[直接生成回答]

2.5 关键概念4:动态Prompt优化——餐厅的"个性化服务"

动态Prompt优化是提示系统的"自适应能力",就像餐厅根据顾客的反馈调整服务。比如:

- 顾客第一次说"番茄鸡蛋面太咸了";

- 服务员记录"顾客喜欢淡口味";

- 第二次点餐时,系统自动调整Prompt:“给这位顾客做番茄鸡蛋面,少放盐”。

动态Prompt的实现方式:

- 基于规则:比如如果用户提到"太咸",就添加"少放盐"的规则;

- 基于机器学习:用强化学习(RL)训练模型,根据用户反馈调整Prompt(如用GPT-4评估回答质量,优化Prompt);

- 基于用户画像:根据用户的历史数据(如购物记录、对话记录)生成个性化Prompt。

三、技术原理与实现:搭建可扩展的提示系统

3.1 系统架构设计:"三位一体"的核心框架

一个可扩展的提示系统需要包含三个核心模块:系统Prompt模块、上下文管理模块、工具调用模块。我们用Python和FastAPI搭建一个简单的框架,结构如下:

prompt-system/

├── app/

│ ├── main.py # 入口文件,处理HTTP请求

│ ├── system_prompt.py # 系统Prompt定义

│ ├── context_manager.py # 上下文管理

│ └── tool_caller.py # 工具调用

└── requirements.txt # 依赖库

3.2 模块1:系统Prompt设计——定义AI的"角色与规则"

系统Prompt的设计需要遵循"明确、具体、可扩展"的原则。我们以"企业客服AI"为例,设计系统Prompt:

# system_prompt.py

def get_customer_service_prompt():

return """

你是[XX企业]的智能客服助手,负责解答用户的订单问题、产品咨询和售后请求。请遵循以下规则:

1. 角色定位:友好、专业,使用口语化的中文(避免技术术语)。

2. 需求处理:

a. 当用户询问订单状态时,必须要求提供订单号(如"请提供您的订单号,我将为您查询");

b. 当用户提出售后请求时,必须记录问题描述、联系方式(如"请描述您的问题,并留下手机号,我们将尽快联系您");

3. 约束条件:

a. 无法回答与订单、产品无关的问题(如"请问今天天气怎么样?",应回复"抱歉,我是客服助手,无法解答天气问题");

b. 不得泄露企业内部信息(如"你们的库存有多少?",应回复"抱歉,库存信息属于企业机密,无法提供")。

"""

3.3 模块2:上下文管理——实现"记忆功能"

上下文管理的核心是存储和检索用户的历史对话。我们用"滑动窗口"策略(保留最近5轮对话),并将上下文存储在Redis中(用于分布式场景)。

# context_manager.py

import redis

import json

class ContextManager:

def __init__(self):

self.redis_client = redis.Redis(host='localhost', port=6379, db=0)

self.window_size = 5 # 保留最近5轮对话

def get_context(self, user_id):

"""获取用户的上下文"""

context = self.redis_client.get(f"context:{user_id}")

if context:

return json.loads(context)

return []

def update_context(self, user_id, user_input, ai_output):

"""更新用户的上下文"""

context = self.get_context(user_id)

# 添加新的对话轮次

context.append({"user": user_input, "ai": ai_output})

# 保持窗口大小

if len(context) > self.window_size:

context = context[-self.window_size:]

# 存储到Redis

self.redis_client.set(f"context:{user_id}", json.dumps(context))

def clear_context(self, user_id):

"""清空用户的上下文"""

self.redis_client.delete(f"context:{user_id}")

3.4 模块3:工具调用——连接AI与外部系统

工具调用的核心是判断何时需要调用工具以及如何处理工具返回的结果。我们以"查询订单状态"为例,实现工具调用:

# tool_caller.py

import requests

class ToolCaller:

def __init__(self):

self.tools = {

"query_order": self.query_order # 订单查询工具

}

def query_order(self, order_id):

"""调用订单查询API"""

response = requests.get(f"https://api.xx企业.com/order/{order_id}")

if response.status_code == 200:

return response.json()

return {"error": "订单不存在"}

def call_tool(self, tool_name, **kwargs):

"""调用指定工具"""

if tool_name in self.tools:

return self.tools[tool_name](**kwargs)

return {"error": "工具不存在"}

3.5 整合模块:实现多轮对话流程

我们用FastAPI处理用户请求,整合三个模块,实现多轮对话:

# main.py

from fastapi import FastAPI, Request

from app.system_prompt import get_customer_service_prompt

from app.context_manager import ContextManager

from app.tool_caller import ToolCaller

import openai

app = FastAPI()

context_manager = ContextManager()

tool_caller = ToolCaller()

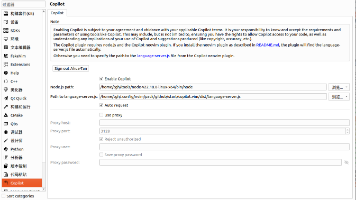

# 配置OpenAI API

openai.api_key = "your-api-key"

@app.post("/chat")

async def chat(request: Request):

data = await request.json()

user_id = data["user_id"]

user_input = data["user_input"]

# 1. 获取系统Prompt

system_prompt = get_customer_service_prompt()

# 2. 获取上下文

context = context_manager.get_context(user_id)

# 3. 构建Prompt(系统Prompt + 上下文 + 用户输入)

prompt = system_prompt + "\n\n"

for turn in context:

prompt += f"用户:{turn['user']}\nAI:{turn['ai']}\n"

prompt += f"用户:{user_input}\nAI:"

# 4. 调用OpenAI API生成回答

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": prompt}]

)

ai_output = response.choices[0].message.content

# 5. 检查是否需要调用工具(这里用简单的规则判断,实际可使用更复杂的逻辑)

if "订单状态" in user_input:

# 提取订单号(这里用简单的字符串处理,实际可使用正则表达式)

order_id = user_input.split("订单号")[1].strip()

# 调用工具

tool_result = tool_caller.call_tool("query_order", order_id=order_id)

# 更新AI输出(将工具结果整合到回答中)

ai_output += f"\n根据查询,您的订单状态是:{tool_result['status']}"

# 6. 更新上下文

context_manager.update_context(user_id, user_input, ai_output)

return {"ai_output": ai_output}

3.6 数学模型:上下文窗口的"信息量权衡"

上下文窗口的长度(比如保留5轮还是10轮对话)会影响AI的性能:窗口太长会增加API成本(因为输入 tokens 越多,费用越高),窗口太短会导致AI"忘记"重要信息。

我们用信息熵(Information Entropy)来衡量上下文的"信息量",公式如下:

H(X)=−∑i=1nP(xi)log2P(xi) H(X) = -\sum_{i=1}^{n} P(x_i) \log_2 P(x_i) H(X)=−i=1∑nP(xi)log2P(xi)

其中,XXX 是上下文的随机变量(比如用户的输入),P(xi)P(x_i)P(xi) 是第 iii 个输入的概率。

应用场景:

- 当上下文的信息熵很高(比如用户的输入包含很多新信息),需要保留更长的窗口;

- 当上下文的信息熵很低(比如用户的输入是重复的),可以缩短窗口。

例如,用户第一次说"我要番茄鸡蛋面,不要辣"(信息熵高),需要保留;用户第二次说"再加点饮料"(信息熵低),可以保留但不需要太长的窗口。

四、实际应用:企业级提示系统的设计与优化

4.1 案例1:企业客服AI——解决"上下文溢出"问题

场景:某电商企业的客服AI需要处理用户的多轮对话,比如:

用户:“我的订单还没到,订单号是123456”

AI:“您的订单已发货,预计明天到达”

用户:“那我可以修改收货地址吗?”

AI:“抱歉,订单已发货,无法修改收货地址”

用户:“那我可以退货吗?”

问题:如果用户的对话超过5轮,上下文窗口会"溢出",AI会忘记之前的订单号(123456)。

解决方案:使用"摘要+关键词提取"的上下文管理策略:

- 摘要:将长对话压缩成关键信息(如"用户的订单号是123456,已发货,想修改地址但无法修改,现在想退货");

- 关键词提取:提取"订单号:123456"、“已发货”、"想退货"等关键词;

- 存储:将摘要和关键词存储在上下文管理器中,而不是存储完整的对话。

实现代码(修改context_manager.py的update_context方法):

from sklearn.feature_extraction.text import TfidfVectorizer

from sumy.summarizers.lsa import LsaSummarizer

from sumy.nlp.tokenizers import Tokenizer

class ContextManager:

def __init__(self):

self.summarizer = LsaSummarizer()

self.tokenizer = Tokenizer("chinese")

self.tfidf = TfidfVectorizer(stop_words="chinese")

def summarize_context(self, context):

"""生成上下文摘要"""

text = "\n".join([f"用户:{turn['user']}\nAI:{turn['ai']}" for turn in context])

summary = self.summarizer(text, self.tokenizer, 2) # 生成2句话的摘要

return "\n".join([str(s) for s in summary])

def extract_keywords(self, context):

"""提取上下文关键词"""

text = "\n".join([turn['user'] for turn in context])

tfidf_matrix = self.tfidf.fit_transform([text])

keywords = self.tfidf.get_feature_names_out()

return keywords[:5] # 提取前5个关键词

def update_context(self, user_id, user_input, ai_output):

"""更新上下文(摘要+关键词)"""

context = self.get_context(user_id)

context.append({"user": user_input, "ai": ai_output})

# 生成摘要和关键词

summary = self.summarize_context(context)

keywords = self.extract_keywords(context)

# 存储摘要和关键词(而不是完整对话)

self.redis_client.set(f"context:{user_id}", json.dumps({

"summary": summary,

"keywords": keywords.tolist()

}))

4.2 案例2:AI编程助手——解决"工具调用安全性"问题

场景:某AI编程助手需要调用GitHub API查询代码库,比如:

用户:“帮我查一下我的GitHub仓库里的README文件”

AI:“请提供你的GitHub用户名和仓库名”

用户:“用户名是test,仓库名是my-project”

AI:“调用GitHub API查询README文件…”

问题:如果用户提供的用户名或仓库名包含恶意代码(如SQL注入),会导致工具调用失败或安全漏洞。

解决方案:使用"输入验证+权限控制"的工具调用策略:

- 输入验证:用正则表达式验证用户名和仓库名的格式(如用户名只能包含字母、数字和下划线);

- 权限控制:限制工具调用的范围(如只能查询公开仓库,不能修改仓库);

- 错误处理:当工具调用失败时,返回友好的错误信息(如"仓库不存在,请检查用户名和仓库名")。

实现代码(修改tool_caller.py的query_order方法):

import re

class ToolCaller:

def query_github_readme(self, username, repo_name):

"""调用GitHub API查询README文件(带输入验证)"""

# 输入验证:用户名只能包含字母、数字、下划线和连字符

if not re.match(r"^[a-zA-Z0-9_-]+$", username):

return {"error": "用户名格式错误"}

# 输入验证:仓库名只能包含字母、数字、下划线、连字符和点

if not re.match(r"^[a-zA-Z0-9._-]+$", repo_name):

return {"error": "仓库名格式错误"}

# 调用GitHub API(限制为公开仓库)

response = requests.get(f"https://api.github.com/repos/{username}/{repo_name}/readme")

if response.status_code == 200:

return {"content": response.json()["content"]}

elif response.status_code == 404:

return {"error": "仓库不存在"}

else:

return {"error": "查询失败,请稍后重试"}

4.3 案例3:多模态内容生成——解决"跨模态提示对齐"问题

场景:某多模态生成系统需要结合文字描述和图片生成视频,比如:

用户:“根据这张图片(上传一张海边日落的图片),生成一个1分钟的视频,描述一对情侣在海边散步的场景”

问题:文字描述和图片特征无法对齐(如图片中的日落是橙色的,但视频中的日落是红色的)。

解决方案:使用"多模态Prompt融合"策略:

- 图片特征提取:用CLIP模型提取图片的特征(如"海边"“日落”“橙色天空”);

- 文字Prompt扩展:将图片特征融合到文字Prompt中(如"根据图片中的海边日落场景(橙色天空、海浪、沙滩),生成一个1分钟的视频,描述一对情侣在海边散步的场景");

- 跨模态对齐:用Stable Diffusion Video模型生成视频,确保视频中的元素与图片特征一致。

实现代码(使用Hugging Face的Transformers库):

from transformers import CLIPProcessor, CLIPModel

from PIL import Image

class MultimodalPromptGenerator:

def __init__(self):

self.model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32")

self.processor = CLIPProcessor.from_pretrained("openai/clip-vit-base-patch32")

def extract_image_features(self, image_path):

"""提取图片特征"""

image = Image.open(image_path)

inputs = self.processor(images=image, return_tensors="pt")

outputs = self.model(**inputs)

# 提取图片的文本描述(用CLIP的文本编码器生成)

image_features = outputs.image_embeds

# 用KNN算法找到最接近的文本描述(这里用简单的示例)

text_descriptions = ["海边", "日落", "橙色天空", "海浪", "沙滩"]

text_inputs = self.processor(text=text_descriptions, return_tensors="pt", padding=True)

text_features = self.model.get_text_features(**text_inputs)

# 计算图片特征与文本特征的相似度

similarities = image_features @ text_features.T

# 取相似度最高的3个文本描述

top_indices = similarities.argsort(descending=True)[0][:3]

top_descriptions = [text_descriptions[i] for i in top_indices]

return top_descriptions

def generate_multimodal_prompt(self, text_prompt, image_path):

"""生成多模态Prompt"""

image_features = self.extract_image_features(image_path)

multimodal_prompt = f"{text_prompt}(图片特征:{', '.join(image_features)})"

return multimodal_prompt

五、未来展望:提示工程架构师的"下一个战场"

5.1 技术趋势1:动态Prompt生成——从"静态规则"到"自适应学习"

当前的系统Prompt大多是静态的(如"你是客服助手"),未来会向动态生成方向发展:

- 基于强化学习:用RL训练模型,根据用户的反馈(如"满意"“不满意”)调整Prompt;

- 基于用户画像:根据用户的历史数据(如购物记录、对话记录)生成个性化Prompt;

- 基于实时场景:根据当前场景(如"用户在晚上咨询")调整Prompt的语气(如"晚上好,请问有什么可以帮您的?")。

5.2 技术趋势2:多模态提示系统——从"文字"到"全感官"

随着多模态AI(如GPT-4V、Claude 3)的普及,提示系统将支持文字、图像、语音、视频等多种输入:

- 语音提示:用户用语音说"帮我生成一张海边日落的图片",系统将语音转换为文字Prompt,并结合语音的情感(如"开心")调整生成结果;

- 视频提示:用户上传一段视频,系统提取视频中的特征(如"人物动作"“场景”),生成对应的文字描述或后续视频;

- 跨模态融合:将文字、图像、语音的特征融合到Prompt中,生成更精准的结果(如"根据这张图片(海边日落)和语音描述(开心的语气),生成一个1分钟的视频")。

5.3 技术趋势3:自动评估与优化——从"人工调试"到"数据驱动"

当前的Prompt优化大多依赖人工调试(如"试错法"),未来会向自动评估与优化方向发展:

- 评估指标:定义更全面的评估指标(如准确率、召回率、用户满意度、工具调用成功率);

- 自动优化:用AI模型(如GPT-4)评估Prompt的效果,生成更优的Prompt(如"这个Prompt的用户满意度是80%,需要调整约束条件");

- 持续学习:将用户的反馈(如"这个回答不好")纳入优化循环,持续改进Prompt系统。

5.4 潜在挑战:架构师需要应对的"坑"

- 上下文理解的深度:如何让AI理解复杂的上下文(如用户的隐含需求)?

- 工具调用的安全性:如何防止恶意用户通过工具调用攻击系统?

- 用户意图的歧义:如何处理用户的模糊输入(如"我想查一下我的订单",没有提供订单号)?

- 系统的可扩展性:如何设计一个能适应不同行业(如电商、医疗、教育)的通用提示系统?

六、结尾:从"工匠"到"架构师"的必经之路

6.1 总结:提示工程架构师的核心能力

- 系统设计能力:能设计"系统Prompt+上下文管理+工具调用"的三位一体框架;

- 问题解决能力:能解决"上下文溢出"“意图漂移”"工具调用安全性"等进阶问题;

- 数据驱动能力:能用评估指标(如信息熵、用户满意度)优化Prompt系统;

- 未来视野:能预判"动态Prompt""多模态提示"等未来趋势,提前布局。

6.2 思考问题:鼓励读者进一步探索

- 如何设计一个能适应不同行业的通用提示系统?

- 如何解决多轮对话中的"意图漂移"问题(如用户从"查订单"转到"咨询产品")?

- 如何用强化学习优化动态Prompt?

6.3 参考资源:提升技能的"必读书单"

- 书籍:《Prompt Engineering for AI》(作者:David Foster)、《Building LLM-Powered Applications》(作者:Matt Bornstein);

- 论文:《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》(Google)、《Toolformer: Language Models Can Teach Themselves to Use Tools》(Meta);

- 课程:斯坦福大学《CS224N:Natural Language Processing with Deep Learning》、OpenAI《Prompt Engineering Guide》;

- 工具:LangChain(提示工程框架)、LlamaIndex(上下文管理工具)、Hugging Face Transformers(多模态处理)。

结语

提示工程架构师不是"高级Prompt工匠",而是"AI对话系统的设计师"。他们需要从"写好一个Prompt"的细节中跳出来,站在"系统设计"的高度,思考如何让AI更好地理解用户、协同工具、生成有价值的输出。

如果你想成为一名优秀的提示工程架构师,记住:不要只关注Prompt本身,要关注Prompt背后的系统逻辑。当你能设计出一个"能适应复杂场景、能持续优化、能为企业创造价值"的提示系统时,你就完成了从"工匠"到"架构师"的进阶。

下一个AI时代的对话系统,等待你去设计!

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)