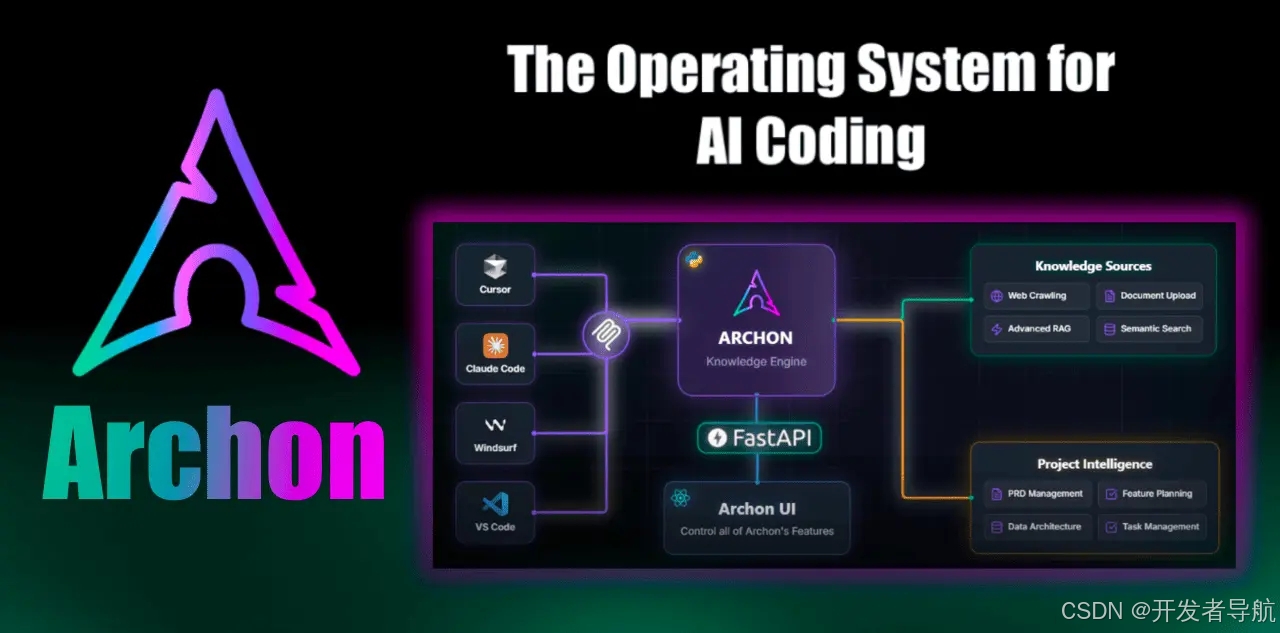

【开发者导航】AI 编程助手的统一项目管理平台:Archon

在 AI 辅助编程日益普及的当下,开发者常常面临这样的困扰:不同 AI 助手(如 Cursor、Windsurf 等)之间信息割裂,项目知识分散在各个工具中,任务进度难以同步,导致协作效率低下。而 Archon 的出现恰好解决了这些问题,它作为专为 AI 编程助手设计的项目管理平台,能让多个 AI 助手共享统一的项目知识与任务进度,通过 MCP 实现本地知识库与任务板的整合,大幅提升 AI 辅助开发的协同效率。想了解更多可访问Archon。

Archon 是什么?

Archon 是一款定位为 AI 编程助手指挥中心的项目管理平台,专为整合不同 AI 助手的工作流而设计。它通过 MCP(Model Context Protocol)实现本地知识库与任务板的无缝衔接,可与 Cursor、Windsurf 等主流 AI IDE 协同工作,支持多种 AI 助手自动参与项目流程,并集成了文档编写、版本控制、GitHub 仓库关联等功能,具体细节以官网更新为准。

核心功能

Archon 的核心价值在于打破不同 AI 编程助手之间的信息壁垒,提升多工具协同开发的效率,尤其适合依赖 AI 辅助的开发者和开发团队。其核心功能如下:

- MCP 整合 —— 通过 Model Context Protocol 实现本地知识库与任务板的统一管理,让 AI 助手共享项目上下文

- 多 IDE 协同 —— 与 Cursor、Windsurf 等主流 AI IDE 无缝对接,支持工具间的信息同步与协作

- 自动流程参与 —— 支持多种 AI 助手按预设流程自动参与项目开发,减少人工协调成本

- 工具库与示例 —— 内置预构建工具、agent 模板和示例库,降低 agent 创建门槛,减少错误

- 文档与版本控制 —— 集成项目文档编写功能,支持版本跟踪,便于追溯项目变更

- GitHub 关联 —— 可关联 GitHub 仓库,实现代码与项目任务的联动管理

- 可视化管理 —— 通过 Streamlit UI 提供直观的操作界面,方便配置环境、监控 agent 状态

- 多模型支持 —— 兼容 OpenAI、Anthropic、Ollama 等多种 AI 模型,灵活适配不同开发需求

使用场景

Archon 适用于多种 AI 辅助编程的场景,不同用户群体可根据需求灵活运用:

|

人群 / 角色 |

场景描述 |

关键步骤要点 |

推荐指数 |

|

独立开发者 |

用多个 AI 助手开发项目,需统一管理知识与进度 |

配置 Archon 连接常用 AI IDE,同步项目文档,设置任务流程 |

★★★★★ |

|

开发团队 |

团队成员使用不同 AI 工具协作,需统一项目信息 |

搭建共享知识库,关联团队 GitHub 仓库,设置 AI 助手自动参与规则 |

★★★★★ |

|

AI 工具集成者 |

为团队定制 AI 辅助工作流,整合多种工具 |

利用 MCP 接口扩展支持的 AI 工具,创建自定义 agent 模板 |

★★★☆☆ |

|

学习者 |

研究 AI 助手协同机制,实践 agent 开发 |

通过示例库学习 agent 创建流程,使用本地 LLM(如 Ollama)测试 |

★★★☆☆ |

操作指南

Archon 的操作流程清晰,开发者可在短时间内上手,具体步骤如下:

- 克隆代码仓库到本地:git clone https://github.com/coleam00/archon.git,进入项目目录

- 选择安装方式:推荐使用 Docker,运行python run_docker.py自动构建并启动容器;或本地安装,创建虚拟环境后执行pip install -r requirements.txt

- 访问 Streamlit UI:打开浏览器访问http://localhost:8501,进入 Archon 管理界面

- 配置环境:在 UI 的 “Intro” section 中设置 API 密钥(OpenAI/Anthropic 等)、数据库连接(Supabase)等参数

- 初始化知识库:根据指引爬取并索引 Pydantic AI 等框架的文档,建立项目知识基础

- 启动 agent 服务:在 UI 中开启 agent 生成服务,根据需求描述创建自定义 AI agent

- 集成 AI IDE:通过 MCP 配置连接 Cursor、Windsurf 等工具,实现信息同步

(注意:使用本地 LLM 时,需确保 Ollama 等服务已正确部署,且与 Archon 网络互通)

支持平台

Archon 主要通过 Web 界面(Streamlit UI)提供服务,支持的部署方式包括:Docker 容器(推荐)、本地 Python 环境(需 Python 3.11+)。兼容的 AI IDE 包括 Cursor、Windsurf 等;数据库依赖 Supabase 作为向量数据库;支持的 AI 模型包括 OpenAI、Anthropic、OpenRouter API 及本地 LLM(如 Ollama),具体兼容版本以官网说明为准。

产品定价

Archon 基于 MIT 开源协议发布,免费提供给用户使用,支持商业场景应用和二次开发,无需支付授权费用。用户可自由修改源码、扩展功能或集成到自有系统中。

常见问题

Q:使用 Archon 需要具备编程知识吗?

A:是的,Archon 主要面向开发者,虽然提供可视化 UI,但配置环境、创建自定义 agent 等操作仍需要基本的编程和命令行使用知识。

Q:Archon 支持哪些 AI 模型?

A:目前支持 OpenAI、Anthropic、OpenRouter API 的模型,以及通过 Ollama 部署的本地 LLM,其中 OpenAI 模型支持 Streamlit UI 中的流式输出功能。

Q:项目数据存储在何处,是否安全?

A:项目知识和配置数据主要存储在用户自建的 Supabase 向量数据库中,用户可掌控数据隐私;本地环境部署时,数据不会上传至第三方服务器,安全性可自行保障。

开发者小结

Archon 的优势在于能有效整合多种 AI 编程助手,统一管理项目知识与任务进度,尤其适合依赖多 AI 工具协作的开发者和团队。其开源特性和丰富的集成能力也为二次开发提供了便利。不过,对于完全不熟悉 AI 工具的新手,可能需要一定时间学习基础操作。总体而言,它是 AI 辅助编程场景中提升协同效率的实用工具。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)