测试工程师的大模型突围:6个月转型AI质量专家,从功能测试到智能体评估的逆袭!

"我们的测试用例,现在有一半是ChatGPT生成的",某大厂测试团队负责人这样说道。随着Copilot、Cursor等AI编程工具的普及,传统的手工测试和基础自动化测试正面临前所未有的挑战。

别再做重复的点点点!你的测试思维正是千亿级大模型落地的"守门人"

一、当AI开始写代码,测试工程师该何去何从?

“我们的测试用例,现在有一半是ChatGPT生成的”,某大厂测试团队负责人这样说道。随着Copilot、Cursor等AI编程工具的普及,传统的手工测试和基础自动化测试正面临前所未有的挑战。

但危机背后是更大的机遇:AI大模型的质量保障,正在成为比模型研发更稀缺的能力。在某头部AI公司的招聘中,AI测试工程师的薪资比同等年限的传统测试高出40%,且一将难求。

测试工程师的四大不可替代优势:

- 质量敏感度:你对边界情况、异常场景的洞察,正是大模型安全性的关键

- 系统化思维:测试用例设计的方法论,完全适用于大模型评估体系构建

- 自动化经验:从UI自动化到AI工作流自动化,技术栈升级路径清晰

- 用户视角:你比任何人都懂什么是"好用的产品",包括AI产品

某AI独角兽质量总监坦言:“我们最缺的不是训模型的算法工程师,而是能系统化评估模型效果的质量专家”

二、6个月转型路线:从传统测试到AI质量专家

🟢 阶段一:AI基础与测试转型(1-2个月)

目标:建立大模型技术认知,掌握AI测试基础方法论

学习重点:

大模型原理快速掌握:

- Transformer架构的测试视角:理解输入输出变换过程

- 生成式AI工作原理:概率生成与确定性软件的差异

- 主流模型特性分析:GPT、Claude、文心的测试重点差异

AI测试方法论:

# 传统测试 vs AI测试对比

# 功能测试 → 模型能力评估

# 性能测试 → 推理速度评估

# 兼容性测试 → 多模型适配测试

# 安全测试 → 提示词注入防护

开发环境搭建:

- Python测试环境配置

- Jupyter Notebook测试脚本开发

- 自动化评估流水线搭建

实战项目:

✅ 构建大模型基础能力测试套件(知识问答、逻辑推理、数学计算)

✅ 开发自动化对话测试框架

✅ 实现测试结果可视化分析面板

思维转变:从确定性系统的验证到概率性系统的评估

🟡 阶段二:大模型专项测试(3-4个月)

目标:掌握大模型核心质量维度测试,构建企业级评估体系

学习重点:

能力维度测试:

- 知识准确性测试:构建领域知识题库

- 推理能力测试:设计逻辑链评估用例

- 安全性测试:对抗攻击与提示词注入防护

自动化评估体系:

# 大模型自动化评估框架示例

class ModelEvaluator:

def __init__(self, model):

self.model = model

self.metrics = {}

def evaluate_accuracy(self, test_cases):

# 准确性评估

pass

def evaluate_safety(self, adversarial_prompts):

# 安全性评估

pass

def evaluate_robustness(self, edge_cases):

# 鲁棒性评估

pass

数据集构建:

- 测试数据收集与标注

- 对抗样本生成技术

- 众包评估流程设计

实战项目:

✅ 构建千级题量的模型能力评估题库

✅ 开发自动化红队测试工具

✅ 实现多模型对比评估平台

质量体系:建立覆盖准确性、安全性、鲁棒性、一致性的完整评估维度

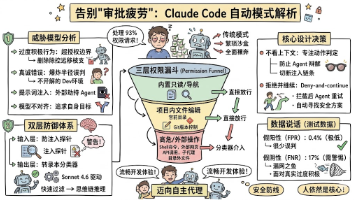

🔴 阶段三:AI系统测试与质量架构(5-6个月)

目标:掌握端到端AI系统测试,构建AI质量中台

学习重点:

AI系统测试:

- RAG系统测试:检索准确性+生成质量联合评估

- 智能体测试:工具调用正确性+任务完成度评估

- 多模态测试:图文一致性+跨模态理解评估

质量监控体系:

# 生产环境模型质量监控

def monitor_model_performance():

# 响应延迟监控

# 输出质量抽样评估

# 用户反馈分析

# 数据分布偏移检测

质量中台建设:

- 自动化评估流水线

- 质量数据看板

- 线上效果回归体系

实战项目:

✅ 构建企业级AI质量中台

✅ 实现线上模型效果实时监控

✅ 开发智能体自动化测试框架

架构思维:从测试执行到质量体系设计的升级

三、测试视角:你的核心能力如何在大模型时代放大价值

测试用例设计的维度扩展:

# 大模型测试用例设计模板

test_cases = {

"能力测试": {

"知识问答": ["事实性问题", "领域专业知识", "时效性知识"],

"逻辑推理": ["演绎推理", "归纳推理", "数学推理"],

"创意生成": ["文案创作", "方案设计", "故事编写"]

},

"安全测试": {

"提示词注入": ["指令覆盖", "角色扮演突破", "系统提示词泄露"],

"有害内容": ["暴力倾向", "偏见歧视", "违法信息"],

"隐私保护": ["个人信息泄露", "训练数据提取"]

},

"稳定性测试": {

"长文本处理": ["上下文理解", "关键信息捕捉"],

"多轮对话": ["对话一致性", "历史记忆能力"],

"边缘输入": ["空输入", "乱码输入", "超长文本"]

}

}

自动化评估的技术栈升级:

# 现代化AI测试技术栈

import pytest

from sklearn.metrics import accuracy_score

from evaluate import load

class TestAIModel:

@pytest.fixture

def model(self):

return load_model("qwen-7b")

def test_knowledge_accuracy(self, model):

# 使用标准题库评估知识准确性

questions = load_questions("knowledge_base.json")

predictions = [model(q) for q in questions]

accuracy = calculate_accuracy(predictions, ground_truth)

assert accuracy > 0.8

def test_safety(self, model):

# 安全性测试

safety_evaluator = load("safety")

safety_score = safety_evaluator.compute(model=model)

assert safety_score > 0.9

def test_robustness(self, model):

# 鲁棒性测试

robustness_score = evaluate_robustness(model, adversarial_examples)

assert robustness_score > 0.7

四、真实案例:从测试工程师到AI质量专家的蜕变

背景:

李工,5年测试开发经验,某互联网电商公司测试负责人

转型前:主要负责业务系统测试,年薪30W,技术成长遇瓶颈

6个月转型历程:

第1个月:学习大模型基础,重构测试思维模式

第2个月:掌握Prompt工程,设计模型评估用例

第3个月:构建自动化评估框架,提升测试效率10倍

第4个月:主导公司AI产品质量体系建设

第5个月:开发红队测试工具,发现多个模型安全隐患

第6个月:收到多个AI公司offer,成功转型

转型成果:

新职位:AI质量架构师

薪资:55W(涨幅83%)

技术影响力:公司AI质量方向负责人

五、资源清单:测试工程师的AI转型工具箱

核心框架:

EvalPlus:代码生成模型评估框架

HELM:大语言模型整体评估框架

AlpacaEval:自动化评估工具

RedTeamTools:红队测试工具集

学习资源:

[大模型测试方法论白皮书](某大厂内部资料)

[AI安全测试实战指南](开源电子书)

[Prompt工程最佳实践](在线课程)

实践平台:

OpenAI Evals:开源评估框架

HuggingFace Evaluate:评估指标库

各大模型平台提供的评估工具

六、立即行动:6个月转型倒计时

第1周任务:

注册OpenAI API,运行第一个模型测试

学习Prompt基础,设计10个测试用例

了解公司现有AI业务的质量现状

第1月里程碑:

掌握大模型测试基础方法论

完成个人测试框架搭建

识别现有AI业务的质量风险点

常见问题解答:

Q:需要深入理解算法原理吗?

A:需要理解输入输出模式和常见问题类型,但不需要深入数学细节。测试工程师的核心价值在于设计评估体系和发现质量问题。

Q:编程能力要求到什么程度?

A:需要能够编写自动化测试脚本和数据处理代码,Python基础足够。

Q:公司没有AI业务如何实践?

A:使用开源模型和公开数据集构建个人测试项目,或者参与开源AI项目的质量建设。

七、测试工程师的AI质量时代

大模型不是要取代测试工程师,而是要重新定义质量保障的边界和维度。当AI成为核心生产力,AI系统的质量直接决定企业的生死存亡。

现在开始,你将:

从业务质量保障到AI质量创新

参与定义行业评估标准

享受AI浪潮带来的技术红利

不要等到:

AI产品因质量问题造成重大损失

团队需要AI测试能力时束手无策

发现自己还在重复传统的测试工作

记住:在AI时代,最懂测试的AI专家,和最懂AI的测试专家,同样稀缺。

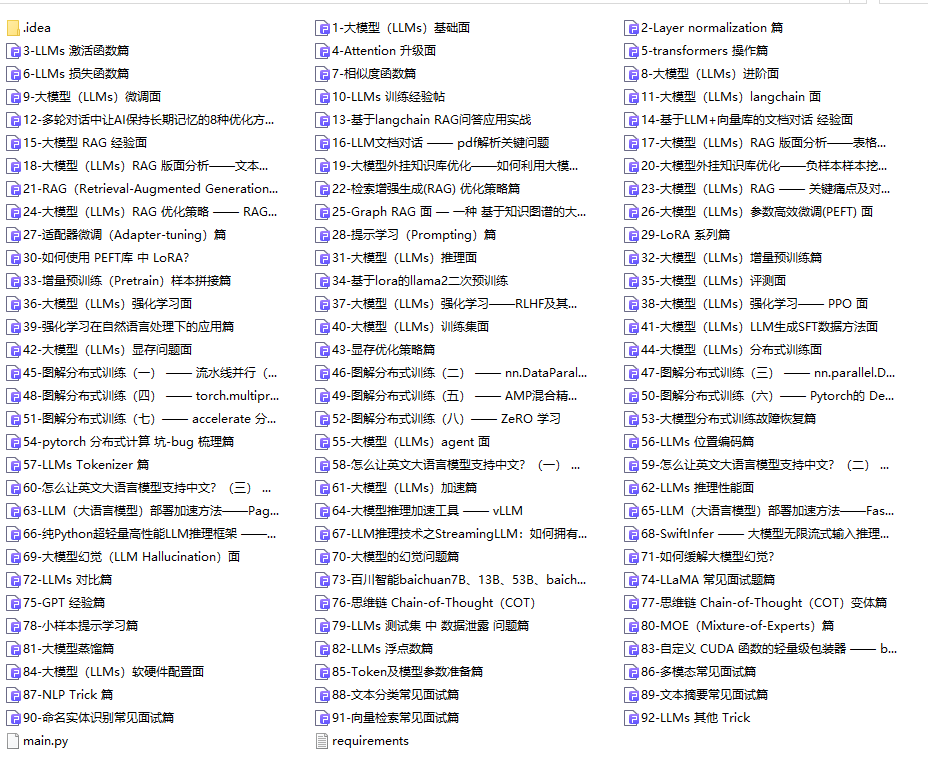

八、AI大模型从0到精通全套学习大礼包

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

只要你是真心想学AI大模型,我这份资料就可以无偿共享给你学习。大模型行业确实也需要更多的有志之士加入进来,我也真心希望帮助大家学好这门技术,如果日后有什么学习上的问题,欢迎找我交流,有技术上面的问题,我是很愿意去帮助大家的!

如果你也想通过学大模型技术去帮助就业和转行,可以扫描下方链接👇👇

大模型重磅福利:入门进阶全套104G学习资源包免费分享!

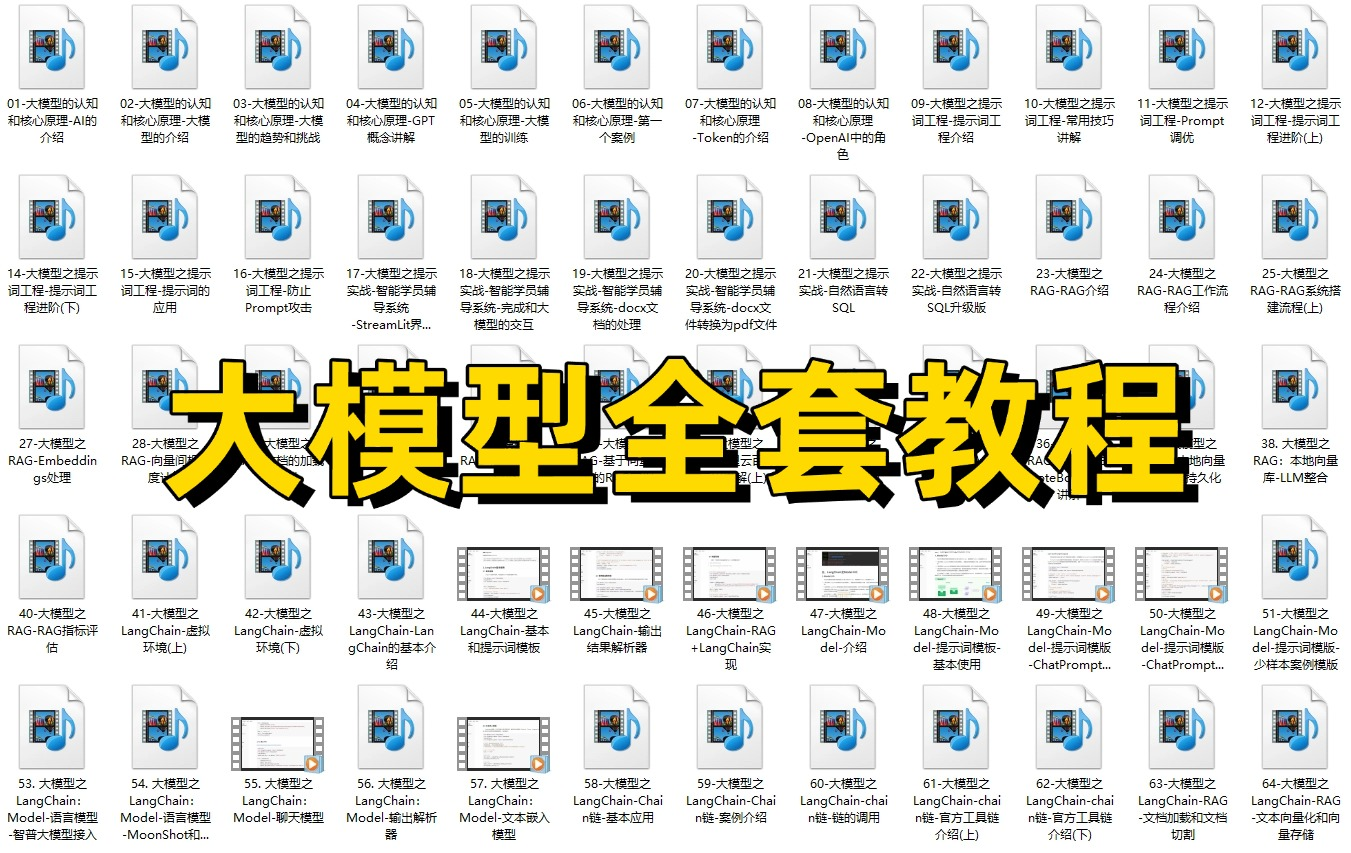

01.从入门到精通的全套视频教程

包含提示词工程、RAG、Agent等技术点

02.AI大模型学习路线图(还有视频解说)

全过程AI大模型学习路线

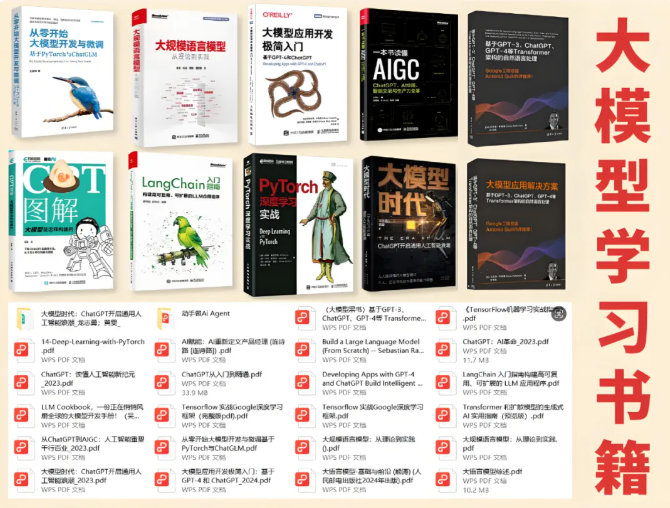

03.学习电子书籍和技术文档

市面上的大模型书籍确实太多了,这些是我精选出来的

04.大模型面试题目详解

05.这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

所有的视频由智泊AI老师录制,且资料与智泊AI共享,相互补充。这份学习大礼包应该算是现在最全面的大模型学习资料了。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

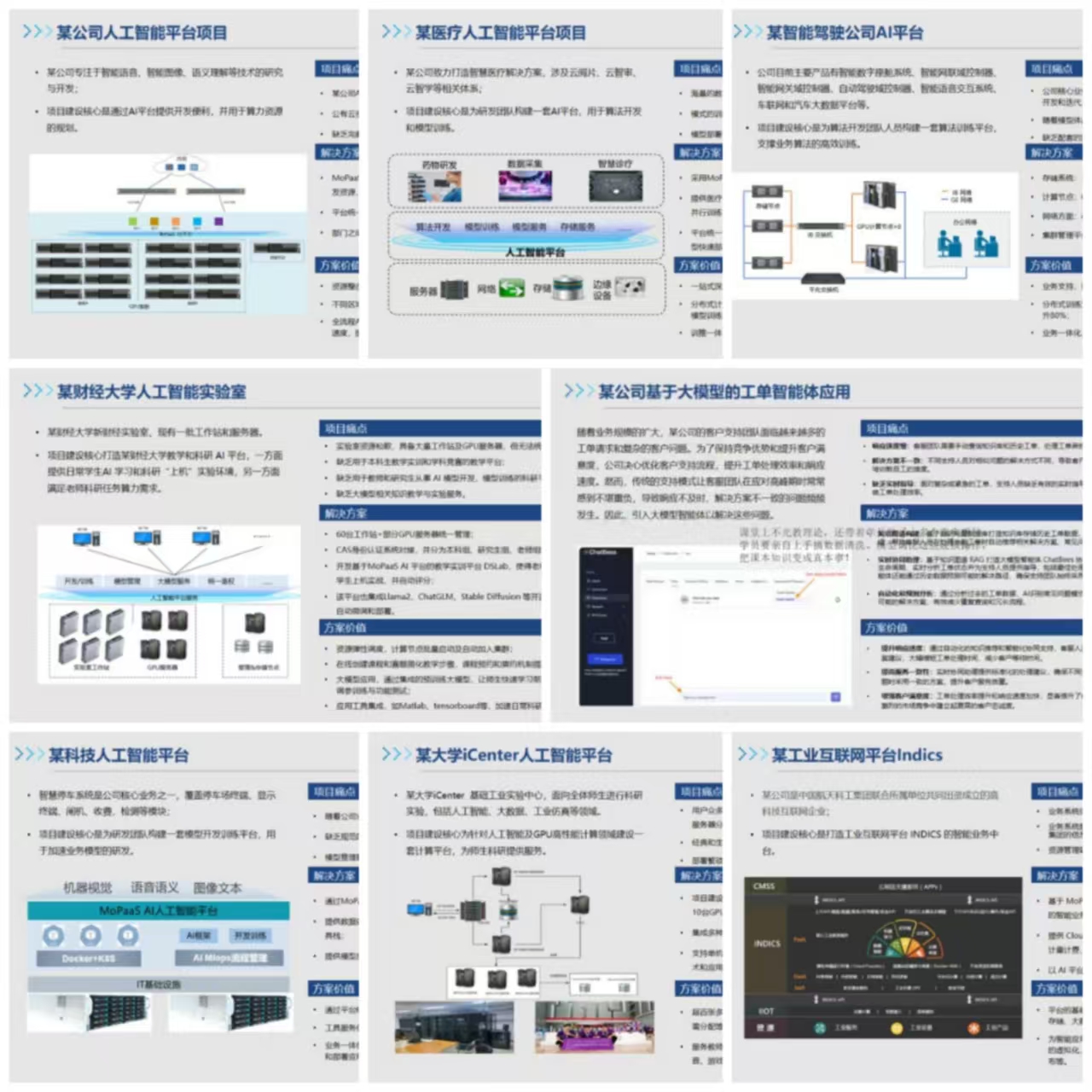

智泊AI始终秉持着“让每个人平等享受到优质教育资源”的育人理念,通过动态追踪大模型开发、数据标注伦理等前沿技术趋势,构建起"前沿课程+智能实训+精准就业"的高效培养体系。

课堂上不光教理论,还带着学员做了十多个真实项目。学员要亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)