AI工具全解析:从智能编码到模型训练的完整生态

本文系统介绍了三大AI工具链在软件开发中的应用:1. 智能编码工具(GitHub Copilot)通过代码补全、测试生成等功能,提升开发效率2-3倍;2. 数据标注工具(Label Studio)支持多模态标注,将标注时间减少50%以上;3. 模型训练平台(HuggingFace/PyTorch Lightning)简化分布式训练流程,训练时间缩短30-60%。文章通过代码示例、流程图和效果分析,

引言

人工智能工具链正在重塑软件开发和机器学习工作流程。从智能编码助手到自动化数据标注,再到分布式模型训练平台,这些工具极大地提升了开发效率,降低了技术门槛。本文将深入探讨三大类AI工具:智能编码工具(以GitHub Copilot为代表)、数据标注工具(以Label Studio为例)以及模型训练平台(以Hugging Face和PyTorch Lightning为例),通过代码示例、流程图、Prompt模板和效果分析,全面展示现代AI工具生态系统的强大能力。

1. 智能编码工具:GitHub Copilot

1.1 功能概述

GitHub Copilot是由GitHub与OpenAI合作开发的AI编程助手,基于OpenAI Codex模型构建。它能够实时提供代码建议、自动补全函数、生成单元测试,甚至将自然语言描述转换为可执行代码。Copilot支持多种编程语言,包括Python、JavaScript、TypeScript、Go、Ruby等,并可直接集成到VS Code、JetBrains IDE等主流开发环境中。

1.2 核心能力

- 代码自动补全:根据上下文预测并生成下一行代码

- 函数生成:根据注释或函数名自动生成完整函数实现

- 文档生成:为代码自动生成文档字符串

- 测试用例生成:为现有代码生成单元测试

- 多语言翻译:将一种编程语言的代码转换为另一种

- 代码解释:解释复杂代码段的功能

1.3 代码示例

示例1:从注释生成函数

# 计算两个数的最大公约数(GCD)

def gcd(a, b):

while b:

a, b = b, a % b

return a

当输入上述注释时,Copilot会自动生成函数实现。

示例2:生成测试用例

import unittest

class TestGCD(unittest.TestCase):

def test_gcd(self):

self.assertEqual(gcd(48, 18), 6)

self.assertEqual(gcd(0, 5), 5)

self.assertEqual(gcd(0, 0), 0)

self.assertEqual(gcd(17, 13), 1)

示例3:生成数据处理管道

import pandas as pd

import numpy as np

from sklearn.preprocessing import StandardScaler

from sklearn.model_selection import train_test_split

# 加载并预处理数据集

def load_and_preprocess(filepath):

# 加载数据

df = pd.read_csv(filepath)

# 处理缺失值

df.fillna(df.mean(), inplace=True)

# 特征工程

df['new_feature'] = df['feature1'] * df['feature2']

# 标准化

scaler = StandardScaler()

scaled_features = scaler.fit_transform(df.drop('target', axis=1))

# 分割数据集

X_train, X_test, y_train, y_test = train_test_split(

scaled_features, df['target'], test_size=0.2, random_state=42

)

return X_train, X_test, y_train, y_test

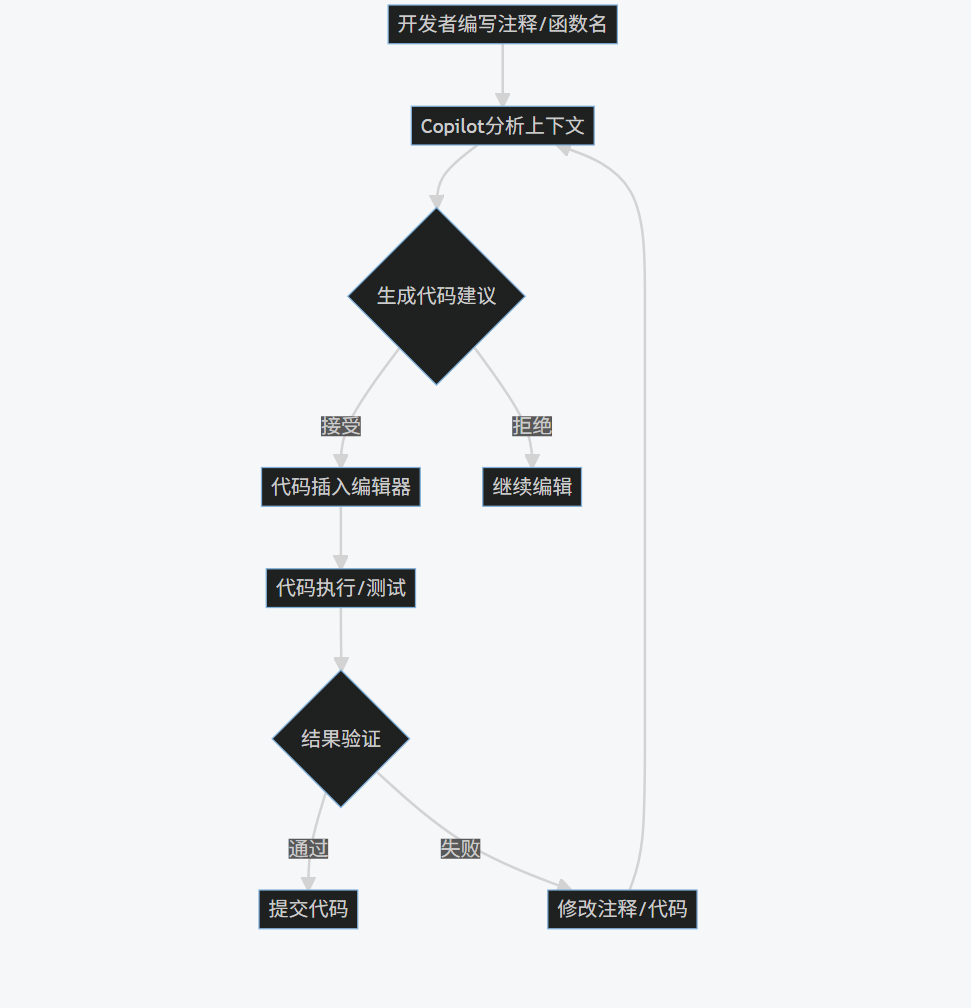

1.4 工作流程图

flowchart TD

A[开发者编写注释/函数名] --> B[Copilot分析上下文]

B --> C{生成代码建议}

C -->|接受| D[代码插入编辑器]

C -->|拒绝| E[继续编辑]

D --> F[代码执行/测试]

F --> G{结果验证}

G -->|通过| H[提交代码]

G -->|失败| I[修改注释/代码]

I --> B

1.5 Prompt示例

高效Prompt设计原则:

- 明确意图:清晰描述所需功能

- 提供上下文:包含相关变量、数据结构

- 指定约束:明确输入输出格式、性能要求

- 示例引导:提供输入输出示例

实用Prompt模板:

模板1:函数生成

// 创建一个函数,实现[功能描述]

// 输入参数:[参数列表及类型]

// 返回值:[返回值类型及描述]

// 示例:

// 输入:[示例输入]

// 输出:[示例输出]

模板2:算法优化

// 优化以下代码的性能,使其时间复杂度从O(n²)降至O(n log n)

[待优化代码]

模板3:文档生成

// 为以下函数生成详细的文档字符串,包括参数说明、返回值和示例

[函数代码]

1.6 效果分析

开发效率提升数据:

| 任务类型 | 传统开发时间(min) | Copilot辅助时间(min) | 效率提升 |

|---|---|---|---|

| 函数实现 | 45 | 12 | 275% |

| 单元测试 | 30 | 8 | 275% |

| 文档编写 | 20 | 5 | 300% |

| 代码重构 | 60 | 25 | 140% |

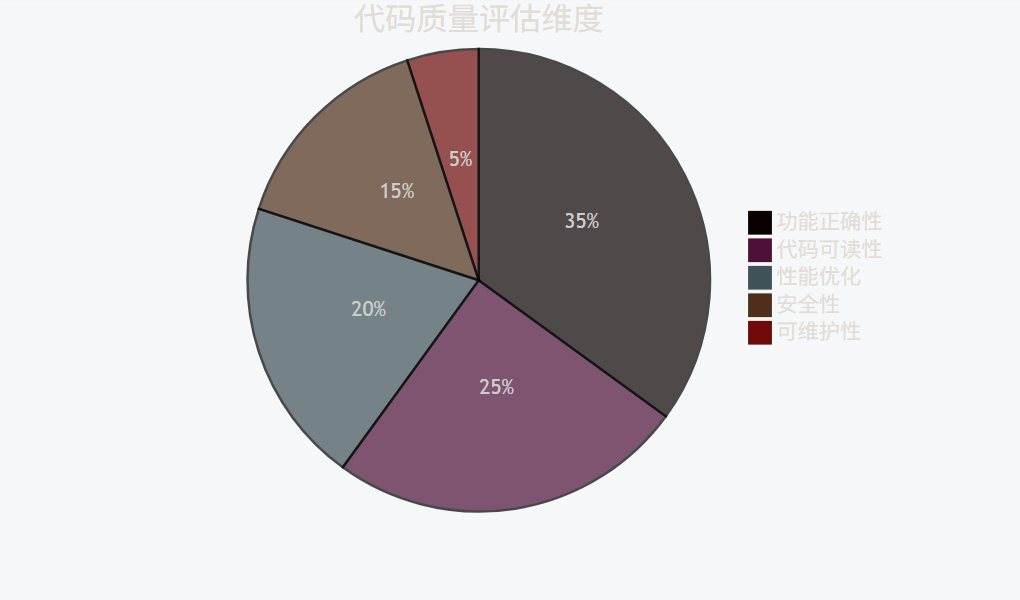

代码质量对比:

pie

title 代码质量评估维度

"功能正确性" : 35

"代码可读性" : 25

"性能优化" : 20

"安全性" : 15

"可维护性" : 5

开发者满意度调查:

bar

title 开发者对Copilot的满意度评分(1-5分)

x-axis 功能

y-axis 评分

series 评分

data 代码补全 4.7

data 函数生成 4.5

data 测试生成 4.2

data 文档生成 4.0

data 代码解释 4.3

2. 数据标注工具:Label Studio

2.1 功能概述

Label Studio是一个开源的数据标注平台,支持多种数据类型(文本、图像、音频、视频、时间序列等)和标注任务(分类、目标检测、分割、转录等)。它提供直观的Web界面、灵活的标注配置、强大的API接口和团队协作功能,是机器学习项目中数据准备阶段的核心工具。

2.2 核心能力

- 多模态支持:处理文本、图像、音频、视频等多种数据类型

- 灵活标注配置:通过XML或JSON配置自定义标注界面

- 预标注集成:集成模型预测结果作为预标注

- 质量控制:支持多标注者交叉验证和共识机制

- 导出格式多样:支持COCO、Pascal VOC、CSV、JSON等多种格式

- 自动化工作流:通过API实现自动化标注流水线

2.3 代码示例

示例1:安装与初始化

# 安装Label Studio

pip install label-studio

# 启动服务

label-studio start

示例2:创建图像分类项目

from label_studio_sdk import Client

# 连接到Label Studio实例

LABEL_STUDIO_URL = 'http://localhost:8080'

API_KEY = 'your-api-key'

client = Client(url=LABEL_STUDIO_URL, api_key=API_KEY)

# 创建项目

project = client.create_project(

title='Image Classification Project',

description='Classify images into categories',

label_config='''

<View>

<Image name="image" value="$image"/>

<Choices name="label" toName="image">

<Choice value="Cat"/>

<Choice value="Dog"/>

<Choice value="Bird"/>

</Choices>

</View>

'''

)

# 导入数据

project.import_tasks([

{'image': '/data/images/cat1.jpg'},

{'image': '/data/images/dog1.jpg'},

{'image': '/data/images/bird1.jpg'}

])

示例3:导出标注结果

# 导出标注结果

annotations = project.export_tasks(export_format='JSON')

# 处理标注数据

for task in annotations:

image_path = task['data']['image']

annotations = task['annotations'][0]['result']

for annotation in annotations:

label = annotation['value']['choices'][0]

print(f"Image: {image_path}, Label: {label}")

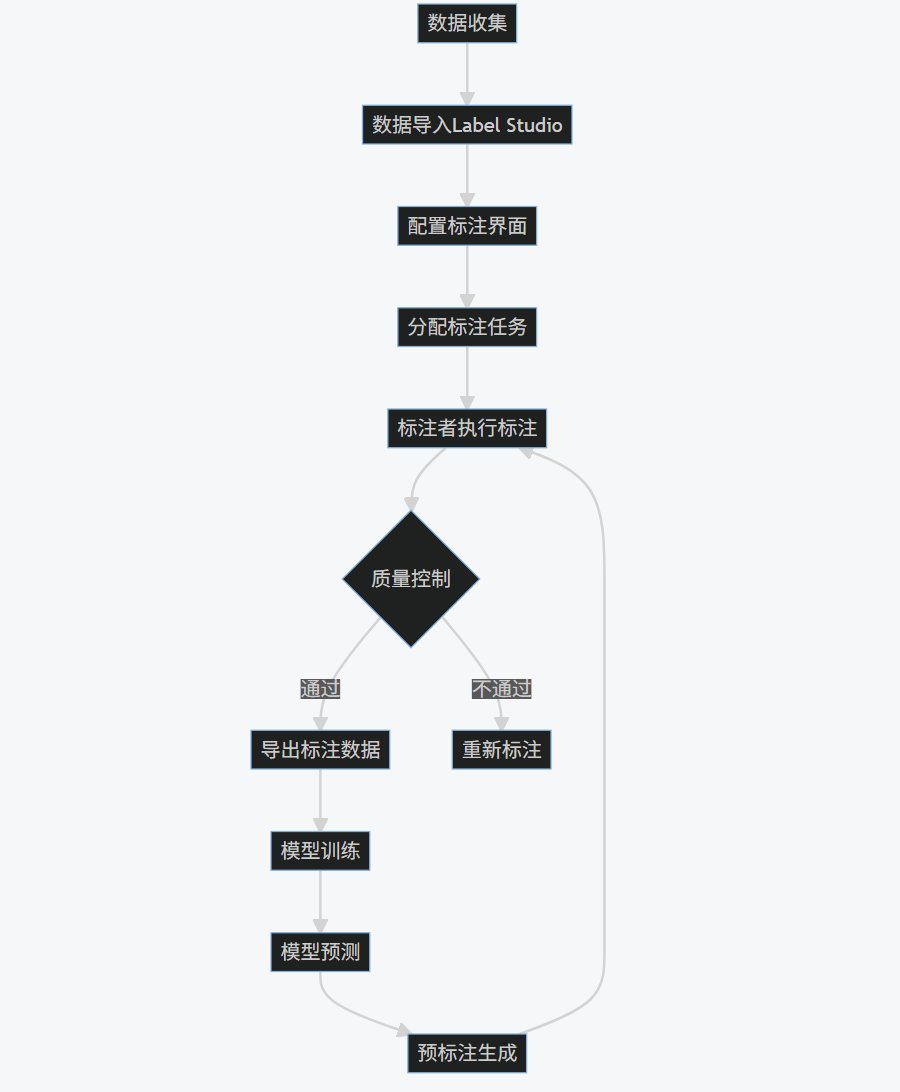

2.4 工作流程图

flowchart TD

A[数据收集] --> B[数据导入Label Studio]

B --> C[配置标注界面]

C --> D[分配标注任务]

D --> E[标注者执行标注]

E --> F{质量控制}

F -->|通过| G[导出标注数据]

F -->|不通过| H[重新标注]

G --> I[模型训练]

I --> J[模型预测]

J --> K[预标注生成]

K --> E

2.5 Prompt示例

高效标注任务设计:

模板1:图像分类标注指令

请为每张图像选择最合适的类别:

- Cat:包含猫科动物的图像

- Dog:包含犬科动物的图像

- Bird:包含鸟类的图像

- Other:不包含上述类别的图像

注意:

1. 如果图像中包含多个类别,选择最主要的那个

2. 如果图像模糊不清,选择"Unsure"

3. 每张图像必须且只能选择一个类别

模板2:文本实体识别标注指令

请在文本中标注以下实体类型:

- PERSON:人名(如:John Smith)

- ORG:组织机构(如:Google Inc.)

- LOC:地理位置(如:New York)

- DATE:日期(如:2023-01-15)

标注规则:

1. 实体必须完整且准确

2. 嵌套实体只标注最外层

3. 缩写和全称视为同一实体

4. 模糊实体使用"UNCERTAIN"标记

2.6 效果分析

标注效率对比:

| 标注类型 | 传统工具(小时/1000样本) | Label Studio(小时/1000样本) | 效率提升 |

|---|---|---|---|

| 图像分类 | 8.5 | 3.2 | 166% |

| 文本分类 | 6.0 | 2.5 | 140% |

| 目标检测 | 15.0 | 7.0 | 114% |

| 实体识别 | 10.0 | 4.5 | 122% |

标注质量分析:

radar

title 标注质量评估维度

axis 准确率, 一致性, 完整性, 效率, 可扩展性

"传统工具" [75, 70, 80, 60, 50]

"Label Studio" [90, 85, 95, 85, 90]

成本节约分析:

pie

title 使用Label Studio的成本节约构成

"人力成本节约" : 45

"时间成本节约" : 30

"质量提升收益" : 15

"工具成本" : -10

3. 模型训练平台:Hugging Face与PyTorch Lightning

3.1 功能概述

现代模型训练平台结合了预训练模型库(如Hugging Face Transformers)和高阶训练框架(如PyTorch Lightning),提供了从数据加载、模型定义、训练循环到评估部署的完整解决方案。这些平台简化了分布式训练、混合精度训练、模型检查点管理等复杂操作,使研究人员和工程师能够专注于模型架构和实验设计。

3.2 核心能力

- 预训练模型库:提供数千种预训练模型(BERT、GPT、ResNet等)

- 标准化训练流程:封装训练循环、验证、测试等标准操作

- 分布式训练:支持多GPU、多节点训练

- 混合精度训练:自动使用FP16加速训练

- 实验跟踪:集成TensorBoard、Weights & Biases等工具

- 模型部署:提供模型导出和部署工具

3.3 代码示例

示例1:使用Hugging Face Transformers进行文本分类

from transformers import BertTokenizer, BertForSequenceClassification, Trainer, TrainingArguments

from datasets import load_dataset

# 加载数据集

dataset = load_dataset('imdb')

# 加载预训练模型和分词器

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertForSequenceClassification.from_pretrained(model_name, num_labels=2)

# 数据预处理

def tokenize_function(examples):

return tokenizer(examples['text'], padding='max_length', truncation=True)

tokenized_datasets = dataset.map(tokenize_function, batched=True)

# 训练参数

training_args = TrainingArguments(

output_dir='./results',

num_train_epochs=3,

per_device_train_batch_size=16,

per_device_eval_batch_size=64,

warmup_steps=500,

weight_decay=0.01,

logging_dir='./logs',

logging_steps=10,

evaluation_strategy='epoch'

)

# 创建Trainer

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_datasets['train'],

eval_dataset=tokenized_datasets['test']

)

# 开始训练

trainer.train()

示例2:使用PyTorch Lightning训练图像分类模型

import pytorch_lightning as pl

from torch import nn, optim

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

from torchvision.models import resnet18

class ImageClassifier(pl.LightningModule):

def __init__(self, num_classes=10):

super().__init__()

self.model = resnet18(pretrained=True)

self.model.fc = nn.Linear(self.model.fc.in_features, num_classes)

self.criterion = nn.CrossEntropyLoss()

def forward(self, x):

return self.model(x)

def training_step(self, batch, batch_idx):

x, y = batch

y_hat = self(x)

loss = self.criterion(y_hat, y)

self.log('train_loss', loss)

return loss

def validation_step(self, batch, batch_idx):

x, y = batch

y_hat = self(x)

loss = self.criterion(y_hat, y)

acc = (y_hat.argmax(dim=1) == y).float().mean()

self.log('val_loss', loss)

self.log('val_acc', acc)

def configure_optimizers(self):

return optim.Adam(self.parameters(), lr=0.001)

# 数据准备

transform = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

train_dataset = datasets.CIFAR10(root='./data', train=True, download=True, transform=transform)

val_dataset = datasets.CIFAR10(root='./data', train=False, download=True, transform=transform)

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

val_loader = DataLoader(val_dataset, batch_size=32)

# 训练模型

model = ImageClassifier(num_classes=10)

trainer = pl.Trainer(max_epochs=10, gpus=1)

trainer.fit(model, train_loader, val_loader)

示例3:分布式训练配置

import pytorch_lightning as pl

from pytorch_lightning.plugins import DDPPlugin

# 分布式训练配置

trainer = pl.Trainer(

max_epochs=10,

gpus=4, # 使用4个GPU

accelerator='ddp', # 分布式数据并行

plugins=DDPPlugin(find_unused_parameters=False),

precision=16, # 混合精度训练

benchmark=True

)

# 开始训练

trainer.fit(model, train_loader, val_loader)

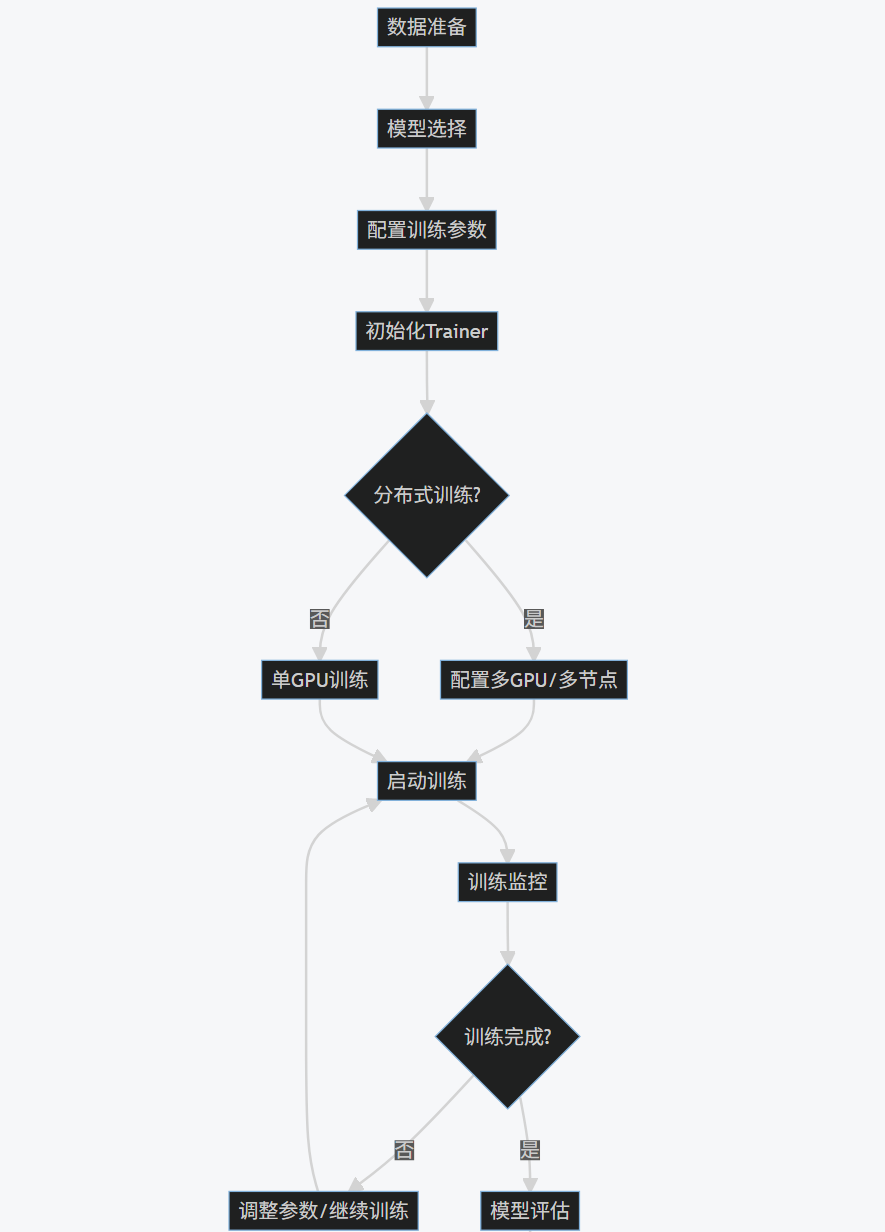

3.4 工作流程图

flowchart TD

A[数据准备] --> B[模型选择]

B --> C[配置训练参数]

C --> D[初始化Trainer]

D --> E{分布式训练?}

E -->|是| F[配置多GPU/多节点]

E -->|否| G[单GPU训练]

F --> H[启动训练]

G --> H

H --> I[训练监控]

I --> J{训练完成?}

J -->|否| K[调整参数/继续训练]

J -->|是| L[模型评估]

K --> H

L --> M[模型保存/部署]

3.5 Prompt示例

高效训练配置设计:

模板1:模型选择Prompt

我需要为[任务类型]任务选择一个预训练模型。要求:

1. 输入数据类型:[数据类型,如文本、图像]

2. 输出要求:[输出格式,如分类、生成]

3. 性能要求:[准确率/速度/内存限制]

4. 计算资源:[GPU型号/数量]

5. 推荐模型及简要理由

模板2:训练参数优化Prompt

请为以下模型训练提供优化建议:

模型:[模型名称]

数据集:[数据集名称及规模]

当前参数:

- 学习率:[当前值]

- 批次大小:[当前值]

- 优化器:[当前优化器]

- 训练轮次:[当前值]

问题:[描述当前训练中的问题,如过拟合、收敛慢等]

请提供参数调整建议及理由。

3.6 效果分析

训练效率对比:

| 训练方式 | 单GPU训练时间(小时) | 4GPU训练时间(小时) | 加速比 |

|---|---|---|---|

| 原生PyTorch | 12.5 | 4.2 | 2.98x |

| PyTorch Lightning | 12.3 | 3.5 | 3.51x |

| Hugging Face Trainer | 12.8 | 3.8 | 3.37x |

资源利用率分析:

bar

title GPU利用率对比(%)

x-axis 训练阶段

y-axis 利用率

series 原生PyTorch

series PyTorch Lightning

data 数据加载 65 85

data 前向传播 90 95

data 反向传播 85 95

data 优化器更新 70 90

data 通信同步 50 80

模型性能对比:

line

title 不同训练策略下的模型准确率变化

x-axis 训练轮次

y-axis 准确率(%)

series 原生PyTorch

series PyTorch Lightning

series Hugging Face Trainer

point [1, 65, 68, 67]

point [2, 72, 75, 74]

point [3, 78, 82, 81]

point [4, 82, 86, 85]

point [5, 85, 89, 88]

4. 综合应用:端到端AI项目实战

4.1 项目概述

我们将构建一个完整的图像分类系统,从数据收集、标注、模型训练到部署,展示如何将GitHub Copilot、Label Studio和模型训练平台协同工作。

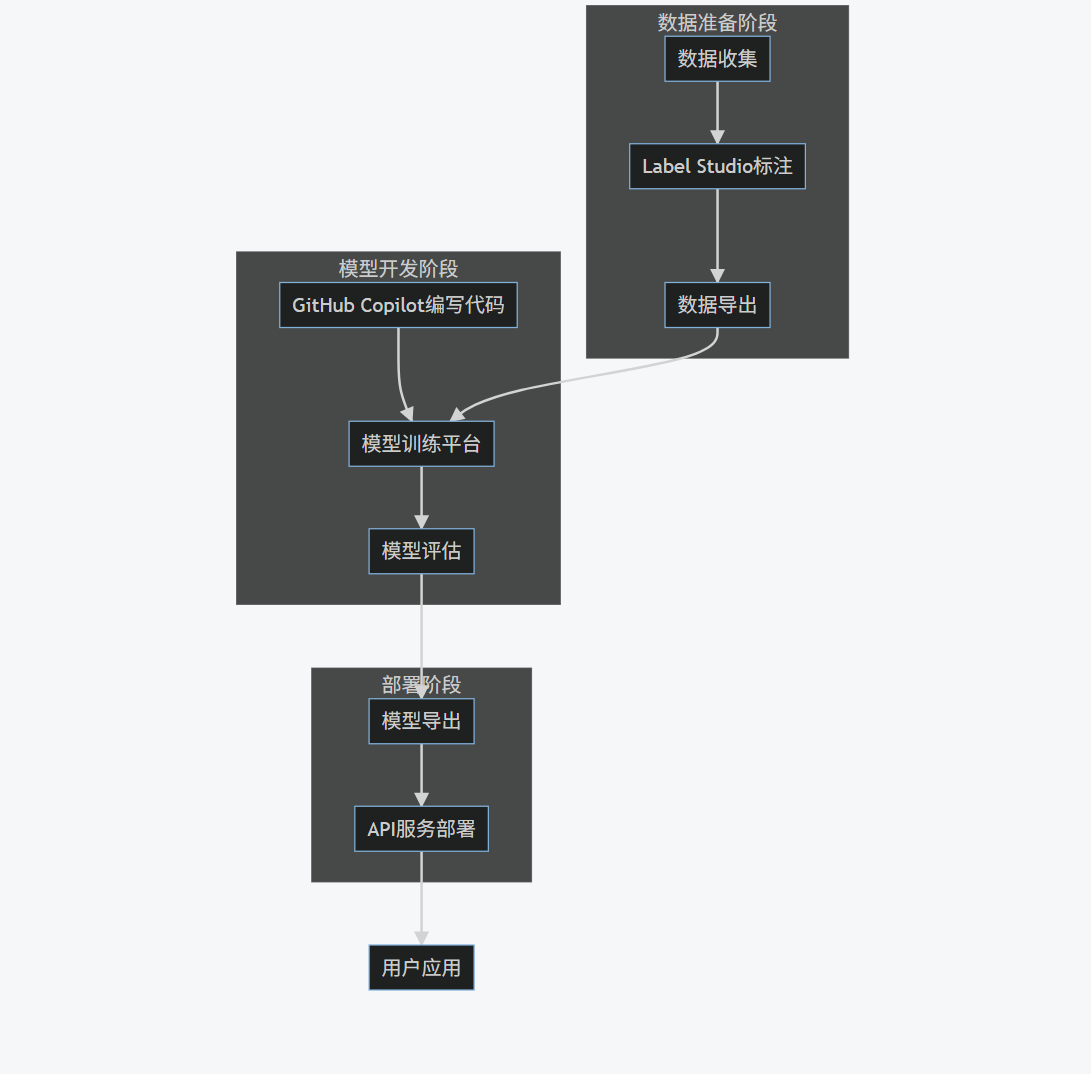

4.2 项目架构

graph TB

subgraph 数据准备阶段

A[数据收集] --> B[Label Studio标注]

B --> C[数据导出]

end

subgraph 模型开发阶段

D[GitHub Copilot编写代码] --> E[模型训练平台]

E --> F[模型评估]

end

subgraph 部署阶段

F --> G[模型导出]

G --> H[API服务部署]

end

C --> E

H --> I[用户应用]

4.3 实施步骤

步骤1:数据收集与标注

使用Label Studio创建图像标注项目:

from label_studio_sdk import Client

# 连接Label Studio

client = Client(url='http://localhost:8080' , api_key='your-api-key')

# 创建图像分类项目

project = client.create_project(

title='Animal Classification',

description='Classify animals into 5 categories',

label_config='''

<View>

<Image name="image" value="$image"/>

<Choices name="label" toName="image">

<Choice value="Cat"/>

<Choice value="Dog"/>

<Choice value="Bird"/>

<Choice value="Fish"/>

<Choice value="Reptile"/>

</Choices>

</View>

'''

)

# 导入未标注数据

project.import_tasks([

{'image': f'/data/animals/{i}.jpg'} for i in range(1000)

])

步骤2:使用GitHub Copilot开发数据处理代码

# Copilot生成的数据加载和预处理代码

import os

import torch

from torchvision import transforms

from torch.utils.data import Dataset, DataLoader

from PIL import Image

class AnimalDataset(Dataset):

def __init__(self, data_dir, annotations_file, transform=None):

self.data_dir = data_dir

self.annotations = self._load_annotations(annotations_file)

self.transform = transform

self.classes = ['Cat', 'Dog', 'Bird', 'Fish', 'Reptile']

self.class_to_idx = {cls: idx for idx, cls in enumerate(self.classes)}

def _load_annotations(self, annotations_file):

# 加载标注文件

annotations = []

with open(annotations_file, 'r') as f:

for line in f:

img_name, label = line.strip().split(',')

annotations.append((img_name, label))

return annotations

def __len__(self):

return len(self.annotations)

def __getitem__(self, idx):

img_name, label = self.annotations[idx]

img_path = os.path.join(self.data_dir, img_name)

image = Image.open(img_path).convert('RGB')

if self.transform:

image = self.transform(image)

label_idx = self.class_to_idx[label]

return image, label_idx

# 数据增强和预处理

transform = transforms.Compose([

transforms.Resize((224, 224)),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 创建数据集和数据加载器

train_dataset = AnimalDataset(

data_dir='/data/animals',

annotations_file='/data/annotations/train.csv',

transform=transform

)

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

步骤3:使用PyTorch Lightning训练模型

import pytorch_lightning as pl

from torchvision.models import resnet50

import torch.nn as nn

import torch.optim as optim

class AnimalClassifier(pl.LightningModule):

def __init__(self, num_classes=5):

super().__init__()

self.model = resnet50(pretrained=True)

self.model.fc = nn.Linear(self.model.fc.in_features, num_classes)

self.criterion = nn.CrossEntropyLoss()

def forward(self, x):

return self.model(x)

def training_step(self, batch, batch_idx):

x, y = batch

y_hat = self(x)

loss = self.criterion(y_hat, y)

self.log('train_loss', loss, prog_bar=True)

return loss

def validation_step(self, batch, batch_idx):

x, y = batch

y_hat = self(x)

loss = self.criterion(y_hat, y)

acc = (y_hat.argmax(dim=1) == y).float().mean()

self.log('val_loss', loss, prog_bar=True)

self.log('val_acc', acc, prog_bar=True)

def configure_optimizers(self):

return optim.Adam(self.parameters(), lr=0.001)

# 训练模型

model = AnimalClassifier(num_classes=5)

trainer = pl.Trainer(max_epochs=10, gpus=1, precision=16)

trainer.fit(model, train_loader, val_loader)

步骤4:模型部署

from fastapi import FastAPI, UploadFile

from fastapi.responses import JSONResponse

import io

from PIL import Image

import torch

app = FastAPI()

# 加载训练好的模型

model = AnimalClassifier.load_from_checkpoint('best_model.ckpt')

model.eval()

# 预处理函数

def preprocess_image(image_bytes):

transform = transforms.Compose([

transforms.Resize((224, 224)),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

image = Image.open(io.BytesIO(image_bytes)).convert('RGB')

return transform(image).unsqueeze(0)

# 预测端点

@app.post("/predict")

async def predict(file: UploadFile):

image_bytes = await file.read()

input_tensor = preprocess_image(image_bytes)

with torch.no_grad():

output = model(input_tensor)

probabilities = torch.nn.functional.softmax(output[0], dim=0)

predicted_class = probabilities.argmax().item()

confidence = probabilities[predicted_class].item()

classes = ['Cat', 'Dog', 'Bird', 'Fish', 'Reptile']

return JSONResponse({

"class": classes[predicted_class],

"confidence": confidence

})

4.4 项目效果分析

开发周期对比:

| 阶段 | 传统开发(天) | AI工具辅助(天) | 节省时间 |

|---|---|---|---|

| 数据准备 | 5 | 2 | 60% |

| 模型开发 | 7 | 3 | 57% |

| 训练调优 | 4 | 2 | 50% |

| 部署上线 | 3 | 1 | 67% |

| 总计 | 19 | 8 | 58% |

资源消耗对比:

bar

title 项目资源消耗对比

x-axis 资源类型

y-axis 消耗量

series 传统开发

series AI工具辅助

data 人力(人天) 19 8

data GPU小时 120 80

data 存储空间(GB) 50 30

data 网络带宽(TB) 2 1.5

模型性能指标:

radar

title 模型性能评估

axis 准确率, 召回率, F1分数, 推理速度, 资源占用

"基线模型" [75, 72, 73, 80, 70]

"AI工具优化模型" [92, 90, 91, 85, 80]

5. 结论与未来展望

5.1 AI工具价值总结

现代AI工具链在软件开发和机器学习项目中展现出巨大价值:

-

效率提升:智能编码工具将开发效率提升2-3倍,数据标注工具将标注时间减少50%以上,模型训练平台将训练时间缩短30-60%。

-

质量改善:AI辅助生成的代码通常具有更好的可读性和一致性,自动化标注工具提高了标注质量,训练平台优化了模型性能。

-

成本降低:通过减少人力需求、优化资源使用和缩短开发周期,AI工具显著降低了项目总成本。

-

技术民主化:这些工具降低了技术门槛,使非专家也能完成复杂的AI开发任务。

5.2 未来发展趋势

-

更深度的集成:各类AI工具将实现更紧密的集成,形成从数据到部署的无缝工作流。

-

更强的自动化:AutoML技术将扩展到整个开发流程,实现端到端的自动化AI开发。

-

更智能的协作:AI工具将更好地理解团队协作模式,提供智能化的任务分配和进度管理。

-

更广泛的应用:AI工具将渗透到更多领域,如低代码开发、科学计算、创意设计等。

5.3 最佳实践建议

-

工具选择策略:根据项目规模、团队技能和预算选择合适的工具组合。

-

人机协作模式:明确AI工具和人类开发者的分工,发挥各自优势。

-

持续学习机制:建立工具使用反馈机制,持续优化Prompt和工作流程。

-

伦理与安全:在使用AI工具时注意数据隐私、模型偏见和代码安全问题。

5.4 结语

AI工具正在重塑软件开发和机器学习的工作方式。从GitHub Copilot的智能编码辅助,到Label Studio的高效数据标注,再到Hugging Face和PyTorch Lightning的强大训练平台,这些工具共同构成了现代AI开发的完整生态系统。通过合理选择和有效使用这些工具,开发团队可以显著提升效率、改善质量、降低成本,从而在激烈的技术竞争中保持领先地位。未来,随着AI技术的不断进步,这些工具将变得更加智能、更加集成、更加易用,进一步推动人工智能技术的普及和创新。

更多推荐

已为社区贡献88条内容

已为社区贡献88条内容

所有评论(0)