GLM-5.1杀疯了!性能暴涨30%直逼Claude Opus,3刀包月干翻200刀的AI编程卷王?

GLM-5.1震撼发布:性能暴涨30%直逼Claude Opus,3刀包月性价比炸裂 国产大模型GLM-5.1低调上线却引发行业地震,其编码能力评分达到45.3分,与行业标杆Claude Opus 4.6(47.9分)差距仅5.4%,价格却低至3美元/月(Claude Max需100-200美元)。升级后的GLM-5.1拥有204800 tokens上下文窗口,能处理复杂项目重构,工具调用准确率显

GLM-5.1杀疯了!性能暴涨30%直逼Claude Opus,3刀包月干翻200刀的AI编程卷王?

家人们,谁懂啊!昨天还在为Claude Max每月200刀的账单肉疼,今天就被智谱这波操作直接干懵了——没有预热、没有发布会、没有全网刷屏的营销海报,GLM-5.1就这么悄无声息地上线了。

但低调归低调,放出来的数据直接炸穿了AI编程圈:

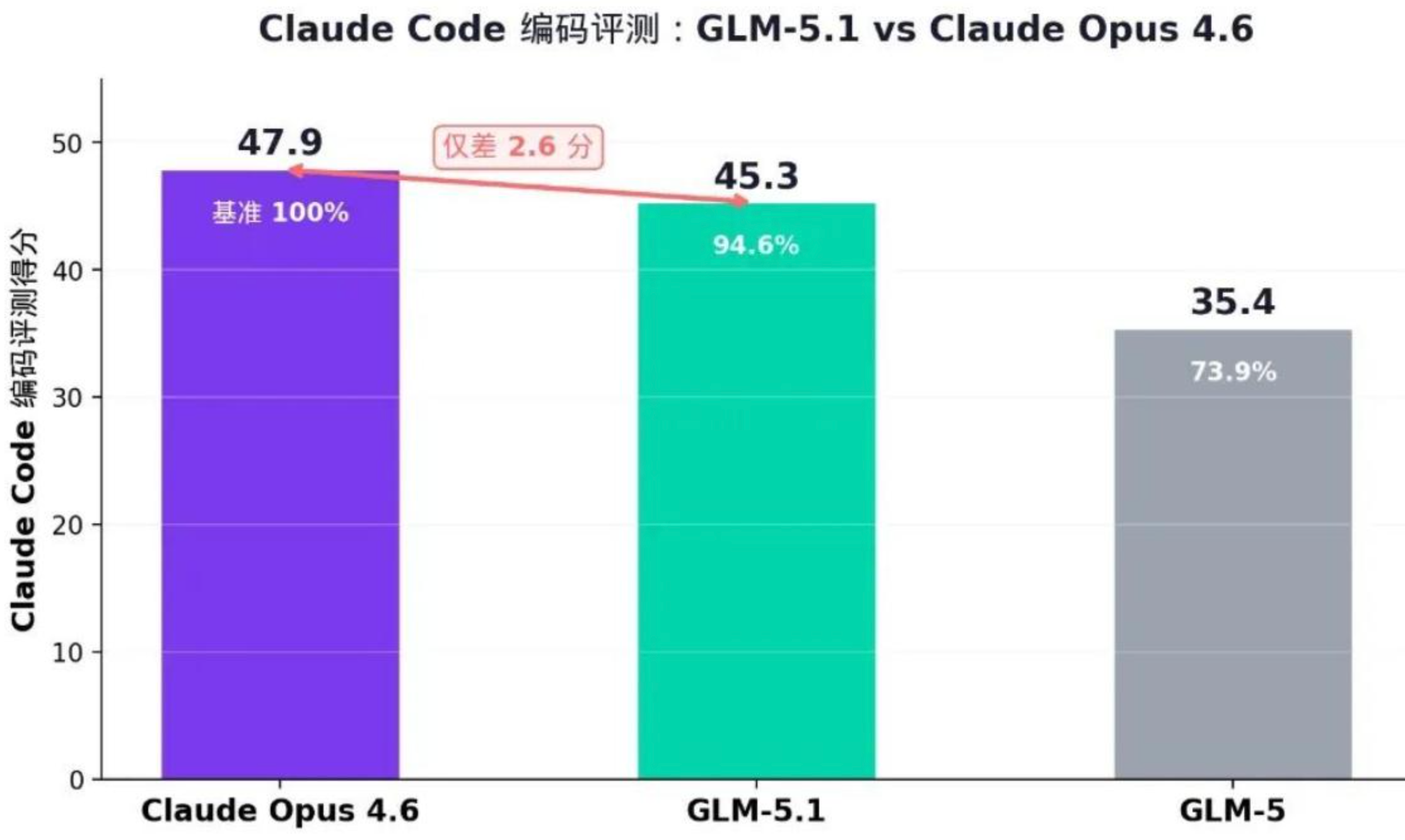

在核心编码能力测评中,GLM-5.1直接拿下45.3分,而行业标杆Claude Opus 4.6的成绩是47.9分,二者差距仅2.6分,GLM-5.1的编码水平直接摸到了Opus的94.6%!

要知道,一个多月前发布的GLM-5才35.4分,这波直接暴涨近30%,堪称坐火箭式升级。更离谱的是,人家Claude Max包月100-200刀,GLM-5.1的Coding Plan促销价3刀就能上车。不到Claude 1/50的价格,拿下94%的核心体验,这波不是内卷,是直接把AI编程的价格天花板给掀了。

硬刚Claude Opus 4.6:2.6分的差距,到底意味着什么?

很多人会问,差2.6分,是不是纸面数据好看,实际用起来天差地别?

作为泡在代码里的老开发,我用了整整一天实测,结论先放这:日常开发场景里,这2.6分的差距,你几乎感受不到。

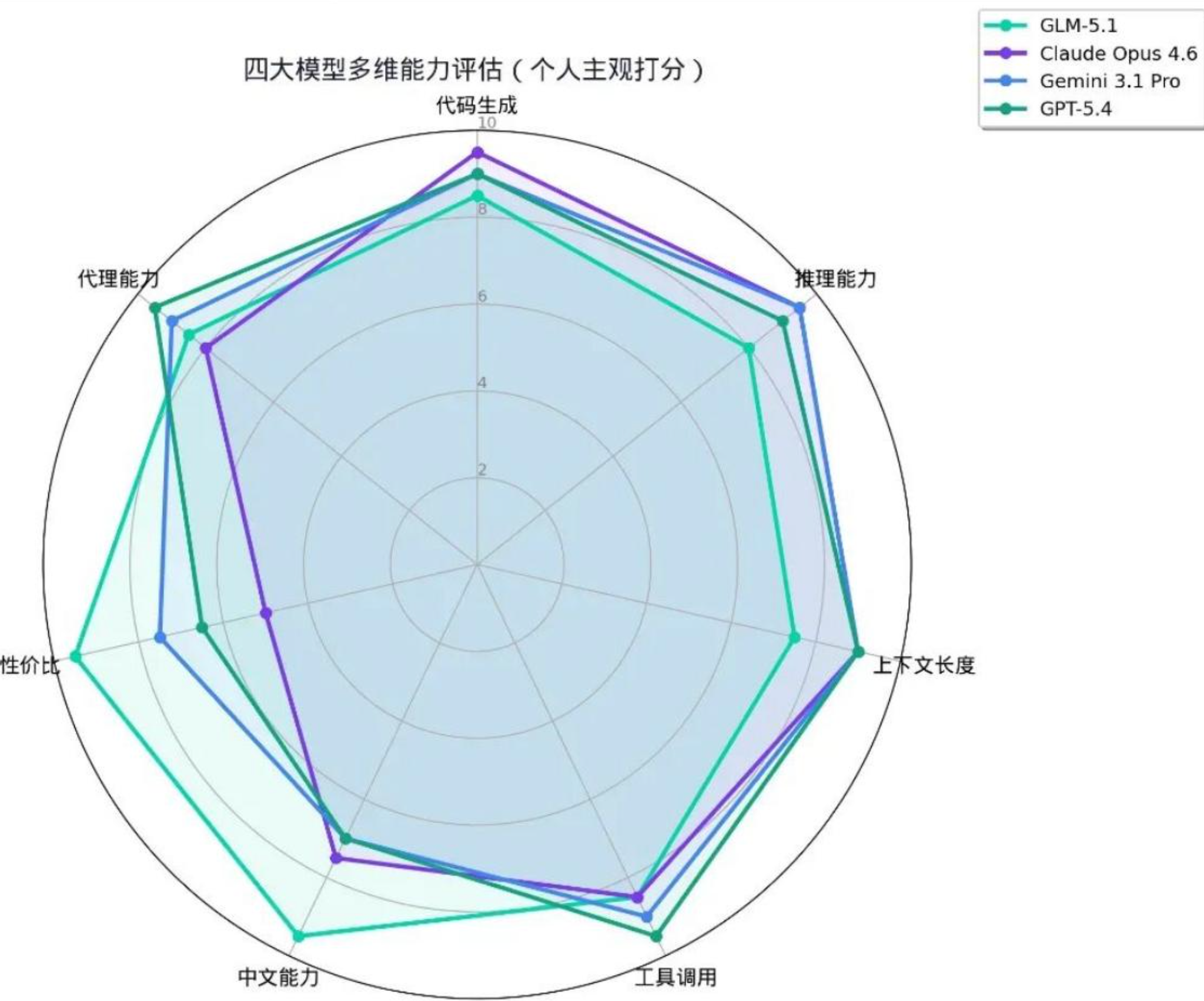

我们先把两款模型的核心能力拉出来做个硬碰硬的对比,一图看懂核心差距:

| 核心维度 | GLM-5.1 | Claude Opus 4.6 | 实际体感差距 |

|---|---|---|---|

| 编码能力评分 | 45.3分 | 47.9分 | 差距仅5.4%,日常开发无感知 |

| 上下文窗口 | 204800 tokens | 1000000 tokens | Opus超长上下文有优势,常规项目GLM完全够用 |

| 最大输出 | 131072 tokens | 官方未明确标注上限 | GLM可一次性输出完整项目重构代码,无截断问题 |

| 月度订阅门槛 | 促销3刀,正式10刀起步 | Pro版20刀,Max版100-200刀 | GLM价格仅为Claude的1/10甚至1/50 |

| 开源属性 | 官方承诺MIT协议开源 | 完全闭源 | GLM可本地部署,企业合规性拉满 |

说白了,Claude Opus 4.6依然是当前AI编程的“天花板”,但GLM-5.1已经把差距缩小到了“日常使用可以忽略不计”的程度。就像你日常通勤开家用车,300匹马力和320匹马力,在城市道路里根本开不出区别,但前者的价格只有后者的零头。

暴涨30%的性能,写代码时到底爽在哪?

光看参数没意思,开发者要的是实打实的体感。这波近30%的提升,不是纸面数字游戏,是真真切切解决了我们用AI写代码时最崩溃的几个痛点。

1. 代码理解:从“看一行忘一行”,升级到“通读全项目”

之前用AI改代码,最崩溃的就是“上下文失忆”:扔个三五千行的项目进去,它只会盯着单个文件改,完全不管跨文件的依赖关系,改完之后到处是报错,还得自己手动擦屁股。

GLM-5.1直接把上下文窗口拉到了204800 tokens,最大输出拉到131072 tokens。啥概念?差不多能一次性塞进一部中篇小说,还能给你完整改完剧情bug。

我实测扔进去一个8000多行的Spring Boot项目,让它重构核心业务模块,它不仅精准完成了单文件的代码优化,居然还能跨文件调整依赖关系,甚至主动把pom.xml里过时的依赖、有安全漏洞的版本全给标记出来了。这种感觉,就像从“单线程读题”直接升级到了“多核并行处理”,再也不用一句一句喂代码了。

2. 工具调用:终于不“抽风”了,一次跑通不再是奢望

用过AI编程工具的开发者,肯定都经历过这种“人工智障”现场:让它用MCP工具查个数据库、跑个自动化脚本,它要么调用格式写错,要么参数传得莫名其妙,一个简单的流程,来回扯皮三四轮才能跑通,最后比自己手写还累。

这波GLM-5.1在工具调用上做了史诗级优化。我用Claude Code接入GLM-5.1,跑了一套完整的自动化测试流程,涉及文件读取、命令行执行、结果解析三个核心环节,整轮下来一次就通,没有任何纠错环节。放在之前用GLM-5的时候,同样的流程,至少要来回调整3次以上,这个体验提升,只有踩过坑的人才懂有多香。

3. 幻觉率肉眼可见下降:终于不“自信满满地胡说八道”了

AI写代码最致命的问题,就是幻觉。明明你项目里没有这个功能,它非说你实现了;明明你用的是Python 3.9,它非得给你整一个3.11才有的语法糖;甚至能凭空编出一个根本不存在的API和参数,还说得头头是道,排查半天发现是它瞎编的,血压直接拉满。

GLM-5.1这次明显“稳重”了太多:遇到不确定的API、不熟悉的框架版本,它会直接说明“这个功能我无法完全确认,建议查阅官方文档核对”,而不是硬着头皮瞎编参数和语法。对开发者来说,这种“知之为知之,不知为不知”的态度,比什么都重要——毕竟我们要的是辅助,不是一个满嘴跑火车的“代码骗子”。

3刀vs200刀!价格屠夫直接把性价比拉满

聊完性能,必须算笔账,毕竟对我们打工人和小团队来说,模型再强,用不起也是白搭。

先看Claude的定价:Pro版每月固定20刀,想用到最强的Opus模型,必须上Max计划,每月100-200刀不等,而且还是按量计费,重度使用的话,一个月账单大几千人民币是常事。

再看GLM-5.1的Coding Plan定价,直接把性价比卷到了极致:

- Lite版:正式价10刀/月,新用户促销价3刀/月

- Pro版:正式价30刀/月,促销价15刀/月

- Max版:更高用量档位,价格依然远低于Claude同级别

最关键的是,订阅期内API调用费用直接免了。有海外开发者实测,用GLM-5.1替代Claude Max做日常开发,同样的工作量,成本直接降到了原来的1/3。一个月省下来的钱,给团队点几轮下午茶、给自己换个新键盘,它不香吗?

我给大家一个最实在的建议:GLM日常+Claude重炮的组合拳。

日常的CRUD开发、API对接、自动化脚本、常规代码重构,直接用GLM-5.1,完全够用;只有遇到百万token级别的超大规模代码库解析、极其复杂的系统架构设计、多轮深度推理的硬核任务,再切到Claude Opus。这样一套下来,成本直接砍掉一大半,体验却几乎没有打折。

零门槛切换!Claude用户一分钟无痛迁移

很多人看到新模型上线,第一反应就是头疼:又要改一堆配置、重新适配工具链、学习新的用法?

放心,智谱这波直接把迁移成本降到了0,说白了就是:你用习惯了Claude的全套工具链,不用改任何使用习惯,后端偷偷换成GLM-5.1就行。

如果你是Claude Code用户,切换到GLM-5.1,真的只需要1分钟:

打开你的配置文件(默认路径~/.claude/settings.json),把API端点和模型名替换成智谱的配置,重启一下服务,直接齐活。配置代码我直接给你们扒出来了,复制粘贴就能用:

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "你的智谱API Key",

"ANTHROPIC_BASE_URL": "https://api.z.ai/api/anthropic",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5.1"

}

}

连环境变量名都不用换,直接复用Claude Code的全套配置体系,这波操作可以说把“抢用户”写在了明面上,但对我们开发者来说,真的太友好了。

如果你用的是Cline、OpenClaw等其他兼容Claude API的工具,配置逻辑完全一致,Base URL填https://open.bigmodel.cn/api/coding/paas/v4,模型名填GLM-5.1,上下文窗口拉到200000,直接就能用。

开源王炸!这才是国产模型最硬的底气

除了性能和价格,GLM-5.1还有一个Claude永远给不了的大招:官方明确承诺,GLM-5.1会以MIT许可证开源。

智谱全球负责人李子轩在海外社交平台直接表态:“Don’t panic. GLM-5.1 will be open source.” 这句话,直接给所有个人开发者和企业用户吃了一颗定心丸。

开源意味着什么?

- 对个人开发者:后续可以本地部署,不用再依赖API服务,甚至不用花钱,就能用到接近Claude Opus水平的编码模型;

- 对企业用户:再也不用担心闭源模型的“卡脖子”风险,不用怕API突然被掐断、价格突然暴涨,代码在自己的服务器上跑,数据不出境,国内合规性直接拉满;

- 对整个行业:MIT开源协议意味着所有人都可以基于它做二次开发、优化迭代,会有无数的开发者和企业一起完善这个模型,它的成长速度会远超闭源的Claude。

实测踩坑指南:这3个坑,千万别踩

吹了这么多,也得给大家说点实在的,我实测了一天,踩了几个小坑,提前给大家避避雷,免得走弯路:

- 切换模型后一定要重启服务。这个看似是常识,但我第一次切换的时候忘了重启Claude Code,结果它还在沿用旧的模型配置,我还以为是GLM-5.1不行,差点错怪好人;

- 复杂任务一定要开Plan Mode。遇到多步执行的复杂项目重构、全流程自动化开发,先让它做规划再执行,别直接扔一句“给我重构整个项目”,很容易漏掉边界情况,先规划再动手,成功率会高很多;

- 刚上线网络偶有波动。虽然官方承诺无网络限制,但我实测的时候遇到过一两次响应延迟,大概率是刚上线访问量太大,介意的朋友可以先观望几天,等流量平稳了再切换。

最后:我们到底需要什么样的AI编程助手?

用了一天GLM-5.1,我最大的感受不是“国产模型又行了”这种空泛的口号,而是真切地觉得,国产大模型真的进入了“和国际顶流并跑”的阶段。

不是那种“差距只有半年”的自我安慰,是实打实的45.3分对47.9分,是不到1/10的价格,是零门槛的迁移,是承诺开源的底气。

我们开发者想要的,从来都不是什么“震撼全网”的发布会,不是天花乱坠的营销话术,而是一个不瞎编、不抽风、能读懂代码、能解决问题、用得起、靠得住的AI助手。

而GLM-5.1这波低调上线,恰恰就是拿产品说话,把所有的诚意都放在了性能、价格和开源承诺里。

如果你现在是GLM Coding Plan用户,建议直接切到5.1试试,反正零成本;如果你还在为Claude的高额账单肉疼,也可以花3刀开个Lite版体验一下,说不定就真香了。

毕竟,在AI编程这个赛道,能用不到五分之一的价格,拿到94%的顶级体验,这种羊毛,不薅白不薅。

你们已经用上GLM-5.1了吗?对比Claude,你的实测体验怎么样?评论区聊聊你的真实感受!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)